6月30日,中国电子学会发布“电子信息领域优秀科技论文遴选活动”最终评选结果,经分组函评和会议终评,2022年共有7篇论文入选电子信息领域优秀科技论文遴选活动(2022)。

《电子与信息学报》推荐文章“《基于生成对抗网络和线上难例挖掘的SAR图像舰船目标检测》”荣誉入选!

李健伟, 曲长文, 彭书娟, 江源. 基于生成对抗网络和线上难例挖掘的SAR图像舰船目标检测[J]. 电子与信息学报, 2019, 41(1): 143-149. doi: 10.11999/JEIT180050

Jianwei LI, Changwen QU, Shujuan PENG, Yuan JIANG. Ship Detection in SAR images Based on Generative Adversarial Network and Online Hard Examples Mining[J]. Journal of Electronics & Information Technology, 2019, 41(1): 143-149. doi: 10.11999/JEIT180050

基金支持:国家自然科学基金(61571454)

论文概览

基于深度学习的SAR图像舰船目标检测算法对图像的数量和质量有很高的要求,而收集大体量的舰船SAR图像并制作相应的标签需要消耗大量的人力物力和财力。

该文在现有SAR图像舰船目标检测数据集(SSDD) 的基础上,针对目前检测算法对数据集利用不充分的问题,提出基于生成对抗网络(GAN)和线上难例挖掘(OHEM)的SAR图像舰船目标检测方法。

利用空间变换网络在特征图上进行变换,生成不同尺寸和旋转角度的舰船样本的特征图,从而提高检测器对不同尺寸、旋转角度的舰船目标的适应性。

利用OHEM在后向传播过程中发掘并充分利用难例样本,去掉检测算法中对样本正负比例的限制,提高对样本的利用率。

通过在SSDD数据集上的实验证明以上两点改进对检测算法性能分别提升了1.3%和1.0%,二者结合提高了2.1%。以上两种方法不依赖于具体的检测算法,且只在训练时增加步骤,在测试时候不增加计算量,具有很强的通用性和实用性。

研究背景与思路

基于深度学习的目标检测方法可以分成两大类:第1类是以Fast R-CNN(Region- based Convolutional Neural Network)为代表的两阶段检测器;第2类是以YOLO和SSD为代表的单阶段检测器。

由于深度学习在目标检测领域的巨大优势,将其应用于SAR图像舰船目标检测是大势所趋。 针对本领域公开数据集缺失、无法统一评判的问题,本文建立了SAR舰船目标检测的数据集(SAR Ship Detection Dataset, SSDD)。通过对深度学习目标检测算法和数据集SS- DD的分析,本文认为对SAR图像中的舰船目标检测尚存在以下两个问题:

(1)难以检测不同角度、不同尺寸的舰船目标;

(2)训练样本利用不充分,简单样本和困难样本没有区别对待,导致模型训练不充分,整体检测效果不好。

针对问题1,本文训练一个对抗器,其通过在特征图上产生仿射变换来生成难例样本,这个对抗器会预测什么样的样本是对Fast R- CNN检测较难的。反过来,Fast R-CNN会调整自身去对这些对抗样本进行分类。随着训练的进行, 目标检测器会慢慢适应对抗网络所产生的各种困难目标,本文通过这种对抗学习策略来提高检测器对各种尺寸和旋转角度目标的适应性。

针对问题2,本文采用在训练时进行难样本挖掘的技术,在前向传播时根据不同样本的损失值将样本分成容易样本与困难样本,在进行后向传播时,对于困难样本进行重点关注,高效地实现了对样本的高利用效率。它同时也去除了Fast R-CNN中对正负样本按比例(正负样本比例1:3)采样的环节,避免少量的难例样本在采样时被忽略。

同时,由于二者在训练过程中是选择不同类型的特征,因此本文将以上两点改进进行组合,可对Fast R-CNN的检测性能有进一步的提升。

算法介绍

本文建立了SAR图像数据集SSDD。该数据集借鉴了PASCALVOC数据集的构建流程,包括了不同分辨率、极化、海况、大片海域和靠岸等条件的SAR图像。SSDD一共有1160个图像,2456条船,平均每幅图像有2.12条船,我们将这个数据按照7:2:1的比例划分成了训练集、测试集和验证集。

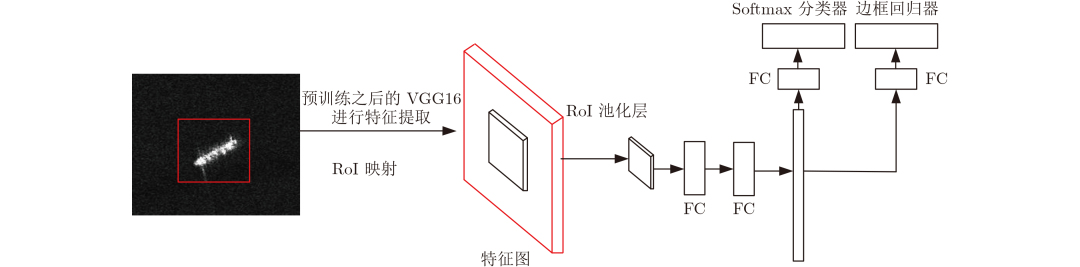

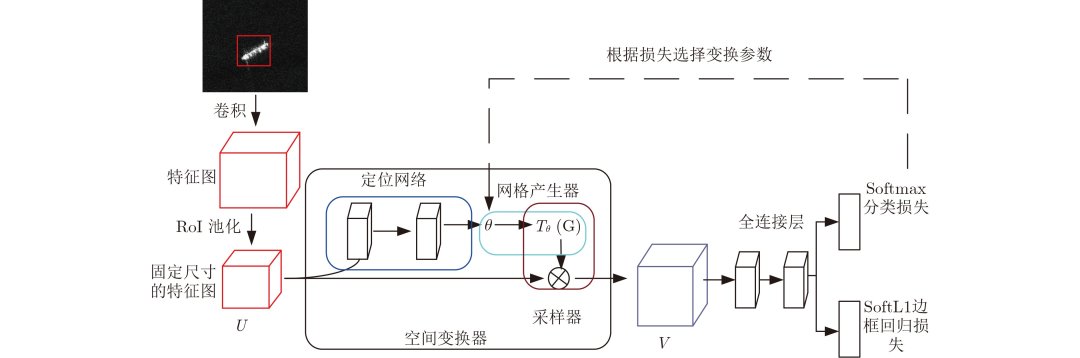

Fast R-CNN目标检测器包括两个步骤:第一,用Selective Search实现的候选区域提取;第二,用于分类与定位的卷积神经网络(CNN)。网络结构有两部分组成:提取特征的卷积神经网络和RoI池化层连接着的全连接层。Fast R-CNN借鉴了SPP-net的池化层并对其进行了简化,使输入的图像大小可变,因为RoI池化层可以将不同大小的特征图重新采样成固定大小的向量,从而作为全连接层的输入。全连接的输出是每个目标类别的概率(包括背景)和目标边框的坐标。Fast R-CNN原理框图如图1所示,图中FC代表全连接层。

图 1 Fast R-CNN原理示意图

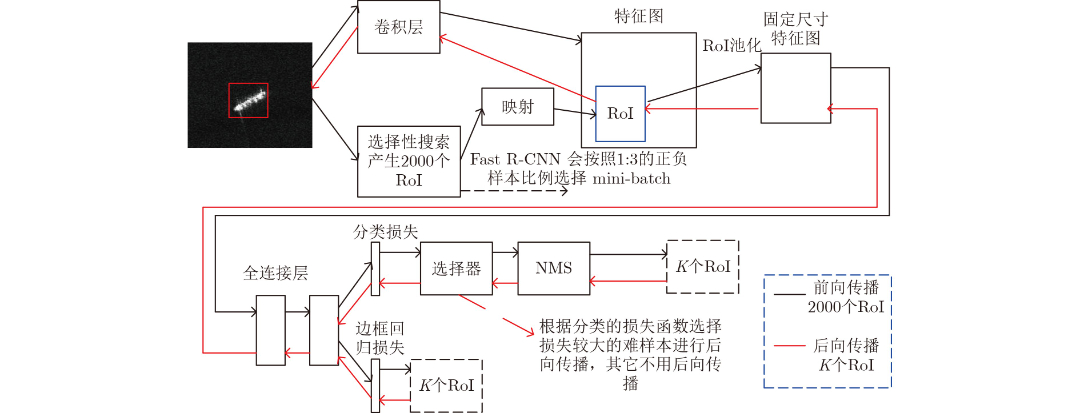

本文引入对抗空间变换网络,中心思想是在目标特征上产生变形,使检测器Fast R-CNN较难检测此类样本。本文的网络是基于使分类更加容易, 能适应各种角度变化和尺度变化等仿射变换的空间变换网络,通过与对抗空间变换网络进行斗争,可以训练一个更好的检测器,使得其检测变形物体更加稳健,对抗空间变换网络结构图如图2所示。

图 2 对抗空间变换网络示意图

传统难例挖掘算法包括两个步骤:模型和数据集交替优化,上述交替方法可以通过线上SGD的方式与Fast R-CNN结合。之所以称为线上,主要是因为操作是在后向传播过程中进行的,不像以前的方法交替优化网络模型和数据。

在原有的Fast-RCNN里的分类损失Lcls里面对所有的候选窗口计算其损失值(包括分类损失Lcls和边框回归损失Lloc),根据分类损失Lcls的大小,从高到低排序,并利用非极大值抑制(NMS),选出前64个难例样本(候选框),对它们进行反向传播,而其他的候选框的梯度不进行回传,流程图如图3所示。

图 3 线上难样本挖掘流程(K=64)

上述过程不需要像Fast R-CNN那样对每个小批量内的数据做类别均衡(前景与背景的比例为1:3)。假设一个小批量内类别不均衡,舰船目标被忽略掉,那么它的损失值会增加,直到含有舰船目标的候选区域被选择为止。即简单样本的分类损失值Lcls较低,对梯度贡献较小,训练会自动地聚焦于那些难例样本。

实验结果分析

实验环境:本文利用Caffe框架在SSDD上去训练检测器,VGG16是基本架构,已在ImageNet进行了预训练,计算环境是64位Ubuntu 14.04操作系统,计算机CPU Intel(R) Core (TM) i7-6770K @4.00 GHz×8和NVIDIA GTX1080 GPU (8 GB 内存) × 4,用CUDA8.0和cuDNN5.0加速。评价指标是mAP,定义为

其中,R为召回率,P为精度。

为了对所提方法性能进行验证,我们在数据集SSDD上进行试验,需要验证的方法有标准的Fast R- CNN、标准的Fast R-CNN+GAN、标准的Fast R-CNN+ OHEM和标准的Fast R-CNN+GAN+OHEM 4种

方法,评价指标包括mAP、每次迭代(batchsize为128)所需训练时间和每幅图像所需的测试时间, CNN模型采用的是VGG16,实验结果如表1所示。

表 1 4种方法检测性能

| 方法 | mAP (%) | 训练时间 (s) | 测试时间 (s) |

| 标准的 Fast R-CNN | 68.0 | 0.610 | 0.328 |

| 标准的 Fast R-CNN+ GAN | 69.4 | 0.823 | 0.326 |

| 标准的 Fast R-CNN+OHEM | 69.1 | 1.152 | 0.321 |

| 标准的 Fast R-CNN+GAN +OHEM | 70.2 | 2.109 | 0.330 |

图4是从数据集SSDD中选出的几个不同尺寸图像,从图中可以看出,检测算法可以适应这些样本。

图 4 数据集SSDD中不同尺度和角度舰船检测结果

图4(g),图4(h)和 图4(i)是从数据集SSDD中选出的几个难例样本的检测结果,从图中可以看出,检测算法可检测出大部分的难例样本(主要是一些靠岸舰船目标),尤其是对于港口区域不需要预处理、海陆分割杂波建模等中间环节,可直接检测出靠岸的舰船目标 。

图4(c)和图4(g)中是典型的靠岸目标,由于训练集包含了大量的靠岸目标,所以训练出来的模型可以检测到这类靠岸的舰船,相比于传统方法一步一步地处理(海陆分割等),本文方法可进行端到端的处理。而且传统方法基本上只对大片海域效果好,本文方法不仅对大片海域效果好,而且还可以端到端的检测到靠岸目标。

需要指出的是,在图4(d)存在虚警(最上面那个框),图4(h) 存在漏检的情况(左上那个框),本文通过平均精度来衡量检测性能的好坏,会不可避免的存在一些虚警和漏警,不过这不能代表整体情况。图中框上的字表示目标类别,这里全是ship(舰船)。

总结

本文提出了在不对数据集样本进行扩充的基础上,通过提高样本利用率的方法来提升检测性能的方法。

通过对抗空间变换网络在特征图上生成各种尺寸和旋转角度的检测目标的特征图,与检测器Fast R-CNN形成对抗训练,最终使检测器能够提高对各种尺寸和旋转角度样本的鲁棒性;

通过在SGD过程中使用OHEM技术,自动选择难例样本进行回传计算梯度,使检测器能够更充分地利用难例样本。

通过在数据集SSDD上的实验,验证了以上两项技术对检测结果的提升。由于两点改进只是对训练阶段进行改进,对预测阶段没有影响,因此不会增加检测算法的耗时。

团队介绍

TEAM

团队主要研究方向为基于深度学习的SAR图像舰船目标检测和识别技术,构建了数据集SSDD、SSDD+和RSDD-SAR,引领了深度学习在SAR图像智能解译领域的应用。

主要成员及简介:

李健伟(1989-),男,博士,工程师,主要研究方向为雷达与电子对抗、SAR 图像智能处理、计算机视觉等。构建了第一个SAR图像舰船目标检测数据集SSDD,以第一作者或通信作者身份发表学术论文十余篇,其中SCI检索4篇、EI检索6篇。论文累计被引692次;单篇最高被引219次,并被评为本领域最具影响力论文;获电子与信息学报2019年高被因论文奖,并被中国电子学会评为2020年度电子信息领域优秀科技论文。出版专著1部。

徐从安(1987-),男,博士,海军航空大学副教授,清华大学访问学者,北京理工大学博士后,青托人才,主要研究方向为多源信息融合、智能信息处理与态势生成、天空基预警探测情报处理研究,先后发表论文 40余篇,SCI、EI检索20余篇,授权专利 8项,软件著作权 2 项,出版专著译著各1部,成果获省部级科研奖励2项。

闫文君(1986-),男,博士,海军航空大学副教授,主要研究方向为智能信息处理、军事大数据和信息对抗,先后发表论文50余篇,SCI、EI检索20余篇,授权专利22项,出版专著1部,成果获得省部级以上科研奖励3项。

吴俊峰(1986-),男,博士,海军航空大学讲师,主要研究方向为遥感图像目标检测和识别,计算机视觉等。先后发表论文20余篇,SCI、EI检索10余篇,授权专利7项,软件著作权 10 项。

高龙(1993-),男,博士,海军航空大学讲师,主要研究方向为SAR 图像智能处理、多源信息融合,先后发表论文20余篇,SCI、EI检索10余篇。

苏航(1998-),男,海军航空大学在读研究生,主要研究方向为SAR舰船检测识别。

最新研究成果:

1. 完成了本领域第一篇长综述[1],相关成果发表在《Remote Sensing》期刊上;

2.构建了SAR舰船斜框检测数据集RSDD-SAR[2],相关成果发表在了《雷达学报》上;

3.将现有数据集合并成一个大数据集,并制定统一的标准和性能基准,实现将SAR图像智能解译纳入到计算机视觉范畴的目的;

4.开展了Rethinking系列相关研究,重新思考计算机视觉领域的目标检测算法创新动机,是否同样适用于SAR图像领域,并基于此提出针对性强的改进;

5.开展辐射源指纹识别技术研究,针对中继辐射源指纹识别提出了基于半监督的识别方法,在同领域有开创性意义。

[1] Li, J.; Xu, C.; Su, H.; Gao, L.; Wang, T. Deep Learning for SAR Ship Detection: Past, Present and Future. Remote Sens. 2022, 14, 2712. https://doi.org/10.3390/rs14112712

[2] 徐从安,苏航,李健伟,刘瑜,姚力波,高龙,闫文君,汪韬阳.RSDD-SAR: SAR舰船斜框检测数据集[J/OL].雷达学报.

[3] Tan,K.,Yan W., Zhang Lm, Ling Q, Xu C. Semi-supervised Specific Emitter Identification Based on Bispectrum Feature Extraction CGAN in Multiple Communication Scenarios[J], IEEE Transactions on Aerospace and Electronic Systems, 2022, DOI :10.1109/TAES.2022.3184619.