Incremental Deep Learning for Remote Sensing Image Interpretation

-

摘要: 深度学习的发展推动了高精度遥感图像智能解译模型的涌现。然而,目前遥感智能解译模型大多基于预先定义的静态数据集独立训练,难以适应环境开放和需求动态的实际应用,严重阻碍了遥感智能解译模型的广域和长期运用。增量学习能使模型持续学习新知识,并保持对旧知识的记忆,近年来,被广泛应用于推动遥感智能解译模型演化、提升模型智能解译性能。该文面向多模态遥感数据、不同类型解译任务,全面调研了遥感图像智能解译增量学习方法,从遗忘问题解决思路、解译模型进化应用两个层面梳理了现有研究工作。在此基础上,从促进遥感图像解译模型进化研究的角度,展望和讨论了遥感领域增量学习的未来研究方向。Abstract: The significant advancement of deep learning has facilitated the emergence of high-precision interpretation models for remote-sensing images. However, a notable drawback is that the majority of interpretation models are trained independently on static datasets, rendering them incapable of adapting to open environments and dynamic demands. This limitation poses a substantial obstacle to the widespread and long-term application of remote-sensing interpretation models. Incremental learning, empowering models to continuously learn new knowledge while retaining previous knowledge, has been recently utilized to drive the evolution of interpretation models and improve their performance. A comprehensive investigation of incremental learning methods for multi-modal remote sensing data and diverse interpretation tasks is provided in this paper. Existing research efforts are organized and reviewed in terms of mitigating catastrophic forgetting and facilitating interpretation model evolution. Drawing from this research progress, this study deliberates on the future research directions for incremental learning in remote sensing, with the aim of advancing research in model evolution for remote sensing image interpretation.

-

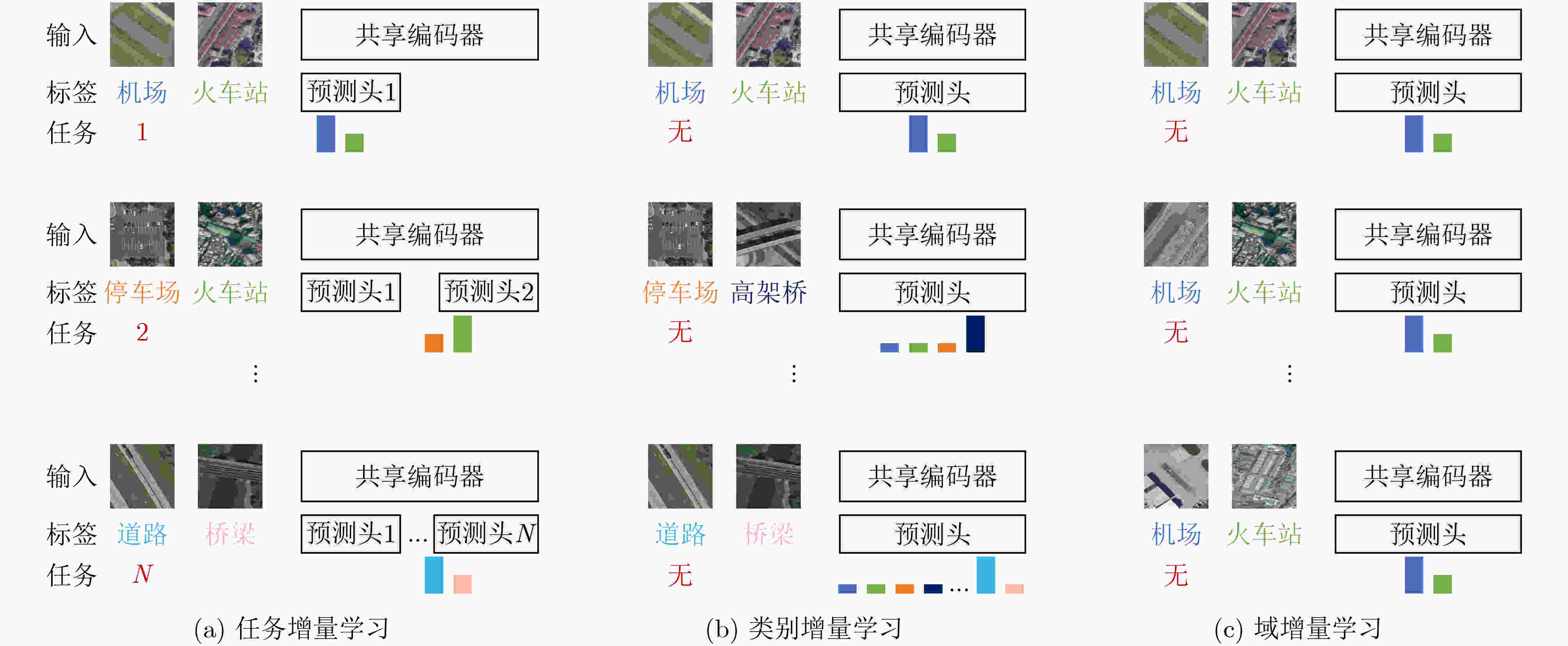

图 1 不同类型的遥感图像场景识别模型进化[23]

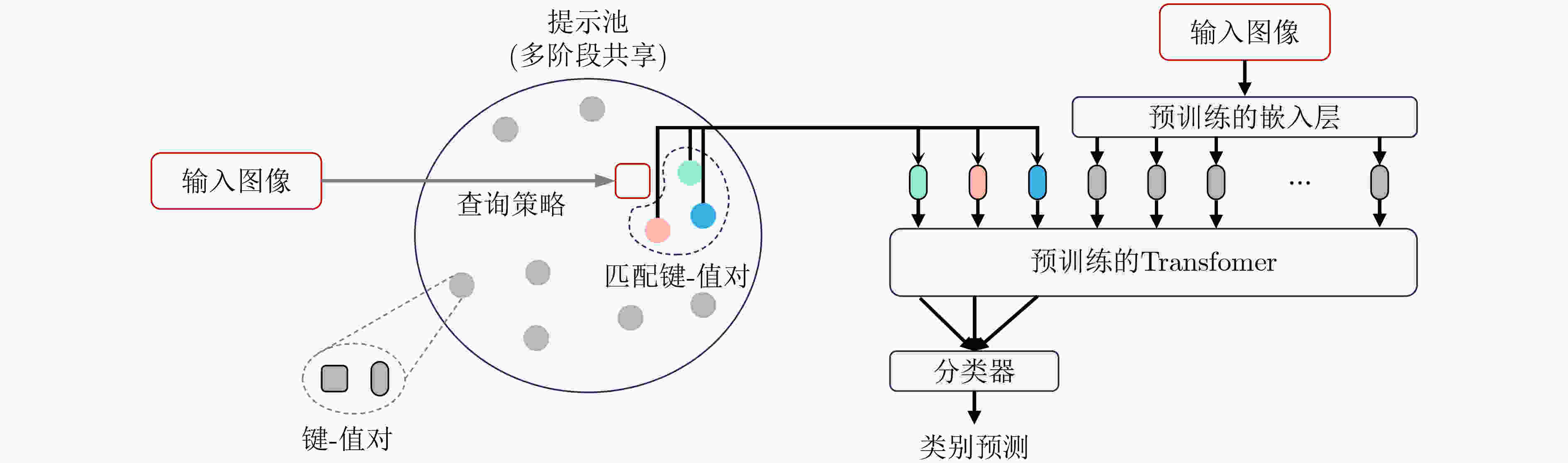

图 4 基于提示的增量学习[68]

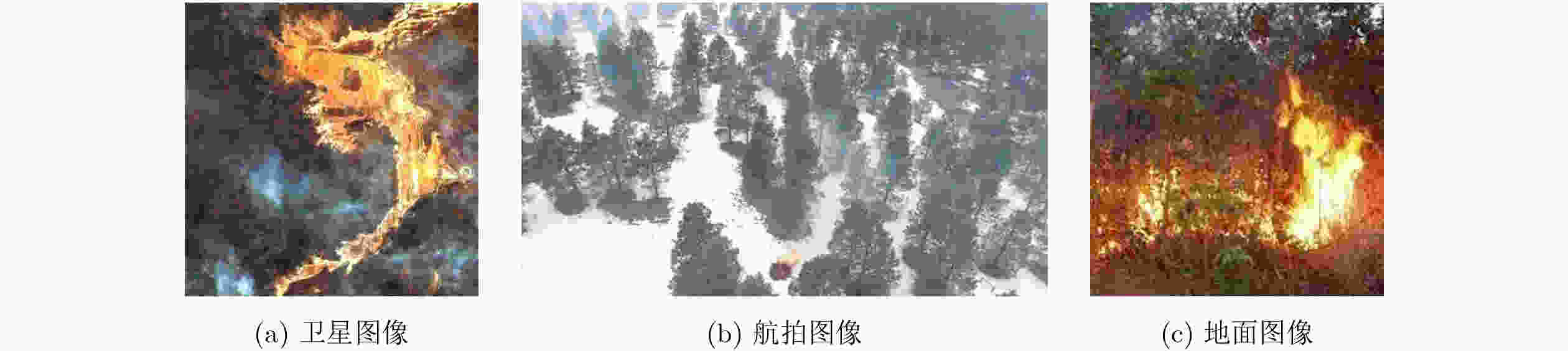

图 5 天空地多源可见光图像[88]

表 1 面向遥感图像解译的增量学习方法对比与总结

方法 核心思想 优点 缺点 代表性成果 知识蒸馏 新旧模型在同一输入图像上的输出保持一致 以损失函数的形式约束模型的参数更新,简单有效且易于实施 旧模型保存,占用一定的存储空间 逐任务知识蒸馏[24] 背景建模知识蒸馏[25] 空间-通道压缩特征蒸馏[26] 结构化知识蒸馏[27,28] 历史信息引导特征蒸馏[29] 网络扩展 增加独立网络参数学习新知识 直接冻结已有网络即可有效保持旧知识 不断扩大的网络规模增加计算和存储成本 增量学习建模为提升过程[30,31] 特征编码器深层结构扩展[32] 残差模块扩展[33,34] 特征迁移模块扩展[35] 记忆回放 保留少部分旧数据,帮助模型回忆旧知识 模型基于新旧数据优化,能够较好地感知新旧知识的边界 旧数据保留增加存储成本,且易产生过拟合 代表性样本选择[36–38] 预测偏差校正[39–46] 旧数据特征生成[24,47] 表 2 面向可见光图像解译的类别增量学习方法总结

解译任务 文献 贡献 遗忘问题解决思路 知识蒸馏 网络扩展 记忆回放 场景识别 [31] 类别增量学习建模为特征提升过程,动态扩展模块化分类网络 $ \surd $ $ \surd $ $ \surd $ [38] 动态混合的样本选择策略和基于异构原型的学习框架,增加存储样本的信息量 $ \surd $ $ \times $ $ \surd $ [64] 利用可学习提示解耦场景识别的知识,避免特定知识的相互干扰缓解遗忘问题 $ \times $ $ \surd $ $ \times $ [65] 相互协作的瞬时网络和保持网络实现有效的旧知识召回和新知识积累 $ \surd $ $ \times $ $ \times $ [37] 凸包构造算法选取接近类边界的样本 $ \times $ $ \times $ $ \surd $ [53] 根据新旧类别的相似性设计类别学习顺序,提高新模型的新类别学习效率 $ \surd $ $ \times $ $ \surd $ [47] 利用VAE生成多样的旧类别特征,避免过拟合和存储成本高的问题 $ \times $ $ \times $ $ \surd $ [40] 平衡的旧数据集微调新模型的预测头,缓解新旧类别不平衡导致的预测偏差 $ \surd $ $ \times $ $ \surd $ [63] 扩展预测头学习新类别,并依据图像特征与任务原型的相似性选择预测头 $ \surd $ $ \surd $ $ \times $ 目标检测 [45] 基于熵的蓄水池抽样策略和样本抽样加权缓解回放不平衡导致的预测偏差 $ \times $ $ \times $ $ \surd $ [49] 在区域候选网络和预测头添加分支并迁移知识,实现新类别学习和旧知识保留 $ \surd $ $ \surd $ $ \times $ 地物分类 [28] 跨图像特征相关性蒸馏损失增强模型的新类别学习能力 $ \surd $ $ \times $ $ \times $ [24] 像素级旧特征生成,应对遗忘问题;逐任务知识蒸馏避免新类别向旧类别压缩 $ \surd $ $ \times $ $ \surd $ [26] 空间-通道维度的特征压缩并迁移,降低特征空间知识蒸馏的计算成本;信息熵量化旧模型预测的准确性,并仅使用高置信度像素预测维持旧知识 $ \surd $ $ \times $ $ \times $ [29] 历史信息引导模型关注前景(旧类别)区域的知识迁移;高置信度的旧模型预测与真实标签相结合,为新模型提供完整的类别监督信息 $ \surd $ $ \times $ $ \times $ [66] 多样蒸馏损失促使模型关注易被遗忘的小目标和目标边缘 $ \surd $ $ \times $ $ \times $ [67] 依据类别实例数量计算每张图像的重要性,确保存储图像的类别均衡 $ \surd $ $ \times $ $ \surd $ 表 3 面向可见光遥感图像解译的类别增量学习常用数据集

解译任务 数据集 图像数量 类别数量 类别增量学习方法 场景识别 NWPU-RESISC45[70] 31500 45 [37,53,64] FGSCR-42[71] 9320 42 [38] PatternNet[72] 30400 38 [53] RSICB-256[73] 28000 35 [31,65] Optimal-31[74] 1860 31 [47,63] AID[75] 10000 30 [31,64,65] CLRS[76] 15000 25 [40] UC-Merced[77] 2100 21 [31,47,63–65] SIRI-WHU[78] 2400 12 [37] 目标检测 DIOR[79] 23463 20 [45,49] DOTA[80] 2806 15 [45,49] NWPU VHR-10[81] 800 10 [45] 地物分类 iSAID[82] 2806 15 [24,28,29] GCSS[83] 948 8 [29] Deepglobe[84] 1146 7 [24,26] Potsdam[85]/Vaihingen[86] 38/33 6 [24,26,28,66,67] Luxcarta[67] – 5 [67,69] 表 4 面向可见光图像解译的类别增量学习方法性能对比

解译任务 研究工作 评价指标 数据集 增量训练次数 得分(%) 发布时间 场景识别 [31] mACC RSICB-256 9 91.10 TGRS’2024 AID 6 86.75 UC-Merced 3 94.29 [38] ACC FGSCR-42 8 89.06 TAES’2024 [64] ACC NWPU-RESISC45 9 72.90 GRSL’2023 AID 6 81.10 UC-Merced 3 92.33 [65] mACC RSICB-256 9 82.63 IEEE/CVF’2022 AID 6 88.93 UC-Merced 3 89.52 [37] ACC NWPU-RESISC45 7 93.47 TGRS’2022 SIRI-WHU 7 98.13 [53] mACC NWPU-RESISC45 9 49.42 JSTARS’2021 PatternNet 6 62.31 [47] ACC Optimal-31 10 86.80 GRSL’2022 UC-Merced 7 94.20 [40] ACC CLRS 4 32.30 CIOP’2021 [63] ACC Optimal-31 10 71.00 GRSL’2022 UC-Merced 7 89.00 目标检测 [45] mAP DIOR 20 34.40 EAAI’2023 DOTA 15 54.90 NWPU VHR-10 10 73.60 [49] mAP DIOR 2 68.45 TGRS’2022 DOTA 2 65.20 地物分类 [28] mIoU iSAID 6 31.88 TGRS’2023 Potsdam 5 74.44 Vaihingen 5 62.54 [24] mIoU iSAID 6 31.71 TGRS’2022 Deepglobe 6 57.00 Potsdam 2 77.70 Vaihingen 3 74.60 [26] mIoU Deepglobe 6 52.40 TGRS’2022 Potsdam 3 76.30 Vaihingen 3 74.10 [29] mIoU iSAID 6 30.21 TGRS’2022 GCSS 5 62.53 [66] mIoU Potsdam 2 75.92 TGRS’2022 Vaihingen 3 73.96 [67] F1 Luxcarta 3 68.09 JSTARS’2019 Potsdam 3 84.25 Vaihingen 3 87.44 表 5 面向可见光图像解译的域增量学习方法总结

解译任务 文献 贡献 遗忘问题解决思路 知识蒸馏 网络扩展 记忆回放 场景识别 [87] 双网络知识协同学习策略增强场景识别模型的新知识学习和旧知识巩固能力 $ \surd $ $ \times $ $ \times $ 目标检测 [88] 为特征空间、输出空间的知识蒸馏添加可学习权重,解决预测偏差问题 $ \surd $ $ \times $ $ \surd $ 地物分类 [30] 域增量学习建模为提升过程,并利用自适应学习率确定每个网络的重要性 $ \times $ $ \surd $ $ \times $ [50] 扩展整个网络,新网络的学习目标是弥补已有模型在新数据上的性能不足 $ \times $ $ \surd $ $ \times $ 变化检测 [34] 输出空间和多层次特征空间的知识蒸馏保留旧知识;扩展域残差单位和解码器,学习新知识 $ \surd $ $ \surd $ $ \times $ 表 6 面向可见光图像解译的域增量学习方法性能对比

解译任务 文献 评价指标 数据集 增量训练次数 得分(%) 发布时间 场景识别 [87] ACC NWPU-RESISC45[70] 5 80.53 计算机应用’2024 AID[75] 5 77.40 目标检测 [88] mAP@0.5 FASDD_CD[91]$ \to $FASDD_RS[91] 2 49.47 JAG’2023 FASDD_RS[91]$ \to $FLAME[92] 2 51.53 地物分类 [30] OA DREAM-B$ ‡ $[30]$ \to $xBD[93]$ \to $Haiti-xBD[30] 3 97.94

(仅新域)ISPRS’2023 [50] IoU DREAM-B[50] 4 63.72 Remote Sens.’2020 变化检测 [34] $ {\varDelta }_{\mathrm{I}\mathrm{o}\mathrm{U}} $ SYSU-CD[89]$ \to $CDD[90]$ \to $PRCV[34] 3 8.22 TGRS’2024 $ \to $:指示模型增量学习顺序 表 7 面向可见光图像解译的任务增量学习方法总结

解译任务 文献 贡献 遗忘问题解决思路 知识蒸馏 网络扩展 记忆回放 场景识别 [35] 特征迁移模块学习相邻任务间的特征分布映射,提升模型的新任务学习能力,并避免了存储成本和推理时间的增加 $ \surd $ $ \surd $ $ \times $ 地物分类 [33] 扩展域残差适应模块和解码器,学习新任务;设计重叠类别的知识蒸馏,应对不同任务的标签空间偏移 $ \surd $ $ \surd $ $ \times $ [27] 约束新旧模型的低层特征逐像素表征一致,同时深层特征像素亲和矩阵相似,

以保留在旧任务数据上学习到的像素交互信息$ \surd $ $ \surd $ $ \times $ 表 8 面向可见光图像解译的任务增量学习性能对比

解译任务 文献 评价指标 数据集 增量训练次数 得分(%) 发布时间 场景识别 [35] mACC AID[75] 10 86.74 TGRS’2022 BigEarthNet[94] 5 95.89 EuroSAT[95] 2 94.85 EuroSAT[95]$ \to $BigEarthNet[94]$ \to $RS-C11[96]$ \to $

RSSCN7[97]$ \to $AID[75]$ \to $SIRI-WHU[78]$ \to $SAT-4[98]7 79.86 地物分类 [33] $ {\varDelta }_{\mathrm{m}\mathrm{I}\mathrm{o}\mathrm{U}} $ GID[99]$ \to $BDCI2020[100]$ \to $Deepglobe[84]$ \to $

LoveDA-Urban[101]$ \to $LoveDA-Rural[101]5 –5.46 Remote Sens.’2023 [27] mIoU Deepglobe[84]$ \to $Potsdam[85]$ \to $GCSS[83] 3 66.27 TGRS’2021 Vaihingen[86]$ \to $Potsdam[85] 2 79.72 $ \to $:指示模型增量学习顺序 表 9 面向合成孔径雷达图像目标识别的类别增量学习方法总结

文献 贡献 遗忘问题解决思路 知识蒸馏 网络扩展 记忆回放 [102] 基于广义最大覆盖的样本选择,降低计算成本 $ \times $ $ \times $ $ \surd $ [56] 基于局部分布统计信息和全局分布密度信息选择代表性样本;评估测试样本的预测可靠性,并由此管理增量数据 $ \times $ $ \times $ $ \surd $ [32] 特征编码器深层结构扩展结合记忆回放、知识蒸馏,应对遗忘问题 $ \surd $ $ \surd $ $ \surd $ [44] 训练样本抽样加权和记忆增强的权重对齐,解决新旧类别不平衡导致的预测偏差 $ \surd $ $ \times $ $ \surd $ [54] Openmax算法帮助模型识别未知类别,此后利用记忆回放赋予模型持续学习未知类别的能力 $ \times $ $ \times $ $ \surd $ [39] 可分离学习策略缓解新旧类别不平衡导致的预测偏差 $ \surd $ $ \times $ $ \surd $ [41] 样本抽样加权,构建类别均衡的训练批次,校正预测偏差 $ \surd $ $ \times $ $ \surd $ [43] 类别分离损失解决新旧类别相似产生的混淆问题;偏差校正层应对新旧类别不平衡现象 $ \surd $ $ \times $ $ \surd $ [46] 类别的有效样本数加权交叉熵损失,解决新旧类别不平衡导致的预测偏差 $ \times $ $ \times $ $ \surd $ [36] 基于局部几何和统计信息的类边界样本选择,并利用SMOTE方法重采样,丰富旧类别样本 $ \times $ $ \times $ $ \surd $ [55] 基于局部几何和统计信息的类边界样本选择 $ \times $ $ \times $ $ \surd $ 表 10 面向合成孔径雷达图像目标识别的类别增量学习方法性能对比

文献 网络架构 评价指标 数据集 每类存储量 增量训练次数 得分(%) 发布时间 [38] ResNet-34 ACC MSTAR 50 10 83.42 TAES’2024 [102] Autoencoder OA MSTAR 50 8 92.54 TGRS’2023 [56] A-ConvNets – MSTAR – – – TGRS’2023 [32] ViT-B ACC MSTAR 20 8 74.65 Remote Sens.’2023 [44] – ACC MSTAR$ + $OpenSARShip 200(11个类别) 12 93.87 GRSL’2023 [54] CNN OA MSTAR – 3 92.70 RadarConf’2023 [39] DCFM-CNN ACC MSTAR 30 7 91.76 TGRS’2022 OpenSARShip 30 3 – [41] ResNet-18 ACC MSTAR$ + $OpenSARShip 200(12个类别) 12 93.87 JSTARS’2022 [43] ResNet-18 ACC (top-5) MSTAR 20 10 97.17 Appli. Sci.’2022 [46] ResNet-18 ACC OpenSARShip – 3 51.15 IGARSS’2022 [36] – ACC MSTAR – 10 – TGRS’2020 [55] – ACC MSTAR 888(9个类别) 8 86.50 TGRS’2019 $ + $:组合不同数据集模拟增量学习阶段 表 11 面向高光谱图像分类的增量学习方法总结

表 12 面向高光谱图像分类的增量学习方法性能对比

-

[1] 周培诚, 程塨, 姚西文, 等. 高分辨率遥感影像解译中的机器学习范式[J]. 遥感学报, 2021, 25(1): 182–197. doi: 10.11834/jrs.20210164.ZHOU Peicheng, CHENG Gong, YAO Xiwen, et al. Machine learning paradigms in high-resolution remote sensing image interpretation[J]. National Remote Sensing Bulletin, 2021, 25(1): 182–197. doi: 10.11834/jrs.20210164. [2] 梅安新, 彭望琭, 秦其明, 等. 遥感导论[M]. 北京: 高等教育出版社, 2001: 171–175.MEI Anxin, PENG Wanglu, QIN Qiming, et al. An Introduction to Remote Sensing[M]. Beijing: Higher Education Press, 2001: 171–175. [3] BI Qi, QIN Kun, ZHANG Han, et al. Local semantic enhanced ConvNet for aerial scene recognition[J]. IEEE Transactions on Image Processing, 2021, 30: 6498–6511. doi: 10.1109/TIP.2021.3092816. [4] BI Qi, ZHOU Beichen, QIN Kun, et al. All grains, one scheme (AGOS): Learning multigrain instance representation for aerial scene classification[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5629217. doi: 10.1109/TGRS.2022.3201755. [5] YANG Yuqun, TANG Xu, CHEUNG Y M, et al. SAGN: Semantic-aware graph network for remote sensing scene classification[J]. IEEE Transactions on Image Processing, 2023, 32: 1011–1025. doi: 10.1109/TIP.2023.3238310. [6] DING Jian, XUE Nan, LONG Yang, et al. Learning RoI transformer for oriented object detection in aerial images[C]. 2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition, Long Beach, USA, 2019: 2844–2853. doi: 10.1109/CVPR.2019.00296. [7] HAN Jiaming, DING Jian, XUE Nan, et al. ReDet: A rotation-equivariant detector for aerial object detection[C]. 2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition, Nashville, USA, 2021: 2785–2794. doi: 10.1109/CVPR46437.2021.00281. [8] LI Yuxuan, HOU Qibin, ZHENG Zhaohui, et al. Large selective kernel network for remote sensing object detection[C]. 2023 IEEE/CVF International Conference on Computer Vision, Paris, France, 2023: 16748–16759. doi: 10.1109/ICCV51070.2023.01540. [9] LI Yansheng, CHEN Wei, HUANG Xin, et al. MFVNet: A deep adaptive fusion network with multiple field-of-views for remote sensing image semantic segmentation[J]. Science China Information Sciences, 2023, 66(4): 140305. doi: 10.1007/s11432-022-3599-y. [10] LIU Yinhe, SHI Sunan, WANG Junjue, et al. Seeing beyond the patch: Scale-adaptive semantic segmentation of high-resolution remote sensing imagery based on reinforcement learning[C]. 2023 IEEE/CVF International Conference on Computer Vision, Paris, France, 2023: 16822–16832. doi: 10.1109/ICCV51070.2023.01547. [11] BERGAMASCO L, BOVOLO F, and BRUZZONE L. A dual-branch deep learning architecture for multisensor and multitemporal remote sensing semantic segmentation[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2023, 16: 2147–2162. doi: 10.1109/JSTARS.2023.3243396. [12] PANG Chao, WU Jiang, DING Jian, et al. Detecting building changes with off-nadir aerial images[J]. Science China Information Sciences, 2023, 66(4): 140306. doi: 10.1007/s11432-022-3691-4. [13] WU Chen, DU Bo, and ZHANG Liangpei. Fully convolutional change detection framework with generative adversarial network for unsupervised, weakly supervised and regional supervised change detection[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2023, 45(8): 9774–9788. doi: 10.1109/TPAMI.2023.3237896. [14] PANG Chao, WENG Xingxing, WU Jiang, et al. HiCD: Change detection in quality-varied images via hierarchical correlation distillation[J]. IEEE Transactions on Geoscience and Remote Sensing, 2024, 62: 5611816. doi: 10.1109/TGRS.2024.3367778. [15] ALHICHRI H. Multitask classification of remote sensing scenes using deep neural networks[C]. 2018 IEEE International Geoscience and Remote Sensing Symposium, Valencia, Spain, 2018: 1195–1198. doi: 10.1109/IGARSS.2018.8518874. [16] MASANA M, LIU Xialei, TWARDOWSKI B, et al. Class-incremental learning: Survey and performance evaluation on image classification[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2023, 45(5): 5513–5533. doi: 10.1109/TPAMI.2022.3213473. [17] DE LANGE M, ALJUNDI R, MASANA M, et al. A continual learning survey: Defying forgetting in classification tasks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2022, 44(7): 3366–3385. doi: 10.1109/TPAMI.2021.3057446. [18] BELOUADAH E, POPESCU A, and KANELLOS I. A comprehensive study of class incremental learning algorithms for visual tasks[J]. Neural Networks, 2021, 135: 38–54. doi: 10.1016/j.neunet.2020.12.003. [19] LIU Hao, ZHOU Yong, LIU Bing, et al. Incremental learning with neural networks for computer vision: A survey[J]. Artificial Intelligence Review, 2023, 56(5): 4557–4589. doi: 10.1007/s10462-022-10294-2. [20] 周大蔚, 汪福运, 叶翰嘉, 等. 基于深度学习的类别增量学习算法综述[J]. 计算机学报, 2023, 46(8): 1577–1605. doi: 10.11897/SP.J.1016.2023.01577.ZHOU Dawei, WANG Fuyun, YE Hanjia, et al. Deep learning for class-incremental learning: A survey[J]. Chinese Journal of Computers, 2023, 46(8): 1577–1605. doi: 10.11897/SP.J.1016.2023.01577. [21] 朱飞, 张煦尧, 刘成林. 类别增量学习研究进展和性能评价[J]. 自动化学报, 2023, 49(3): 635–660. doi: 10.16383/j.aas.c220588.ZHU Fei, ZHANG Xuyao, and LIU Chenglin. Class incremental learning: A review and performance evaluation[J]. Acta Automatica Sinica, 2023, 49(3): 635–660. doi: 10.16383/j.aas.c220588. [22] VAN DE VEN G M, TUYTELAARS T, and TOLIAS A S. Three types of incremental learning[J]. Nature Machine Intelligence, 2022, 4(12): 1185–1197. doi: 10.1038/s42256-022-00568-3. [23] HIHN H and BRAUN D A. Hierarchically structured task-agnostic continual learning[J]. Machine Learning, 2023, 112(2): 655–686. doi: 10.1007/s10994-022-06283-9. [24] SHAN Lianlei, WANG Weiqiang, LV Ke, et al. Class-incremental semantic segmentation of aerial images via pixel-level feature generation and task-wise distillation[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5635817. doi: 10.1109/TGRS.2022.3231351. [25] CERMELLI F, MANCINI M, BULÓ S R, et al. Modeling the background for incremental and weakly-supervised semantic segmentation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2022, 44(12): 10099–10113. doi: 10.1109/TPAMI.2021.3133954. [26] SHAN Lianlei, WANG Weiqiang, LV Ke, et al. Class-incremental learning for semantic segmentation in aerial imagery via distillation in all aspects[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5615712. doi: 10.1109/TGRS.2021.3135456. [27] FENG Yingchao, SUN Xian, DIAO Wenhui, et al. Continual learning with structured inheritance for semantic segmentation in aerial imagery[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5607017. doi: 10.1109/TGRS.2021.3076664. [28] RONG Xuee, WANG Peijin, DIAO Wenhui, et al. MiCro: Modeling cross-image semantic relationship dependencies for class-incremental semantic segmentation in remote sensing images[J]. IEEE Transactions on Geoscience and Remote Sensing, 2023, 61: 5616218. doi: 10.1109/TGRS.2023.3297203. [29] RONG Xuee, SUN Xian, DIAO Wenhui, et al. Historical information-guided class-incremental semantic segmentation in remote sensing images[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5622618. doi: 10.1109/TGRS.2022.3170349. [30] GE Jiayi, TANG Hong, YANG Naisen, et al. Rapid identification of damaged buildings using incremental learning with transferred data from historical natural disaster cases[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2023, 195: 105–128. doi: 10.1016/j.isprsjprs.2022.11.010. [31] YE Zhen, ZHANG Yu, ZHANG Jinxin, et al. A multiscale incremental learning network for remote sensing scene classification[J]. IEEE Transactions on Geoscience and Remote Sensing, 2024, 62: 5606015. doi: 10.1109/TGRS.2024.3353737. [32] PAN Qidi, LIAO Kuo, HE Xuesi, et al. A class-incremental learning method for SAR images based on self-sustainment guidance representation[J]. Remote Sensing, 2023, 15(10): 2631. doi: 10.3390/rs15102631. [33] RUI Xue, LI Ziqiang, CAO Yang, et al. DILRS: Domain-incremental learning for semantic segmentation in multi-source remote sensing data[J]. Remote Sensing, 2023, 15(10): 2541. doi: 10.3390/rs15102541. [34] WENG Lean, YANG Wenqing, HU Boni, et al. MDINet: Multidomain incremental network for change detection[J]. IEEE Transactions on Geoscience and Remote Sensing, 2024, 62: 4402315. doi: 10.1109/TGRS.2023.3348878. [35] LU Xiaonan, SUN Xian, DIAO Wenhui, et al. LIL: Lightweight incremental learning approach through feature transfer for remote sensing image scene classification[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5611320. doi: 10.1109/TGRS.2021.3102629. [36] DANG Sihang, CAO Zongjie, CUI Zongyong, et al. Class boundary exemplar selection based incremental learning for automatic target recognition[J]. IEEE Transactions on Geoscience and Remote Sensing, 2020, 58(8): 5782–5792. doi: 10.1109/TGRS.2020.2970076. [37] LIU Weiwei, NIE Xiangli, ZHANG Bo, et al. Incremental learning with open-set recognition for remote sensing image scene classification[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5622916. doi: 10.1109/TGRS.2022.3173995. [38] FU Yimin, LIU Zhunga, WU Changyuan, et al. Class-incremental recognition of objects in remote sensing images with dynamic hybrid exemplar selection[J]. IEEE Transactions on Aerospace and Electronic Systems, 2024. doi: 10.1109/TAES.2024.3363114. [39] LI Bin, CUI Zongyong, CAO Zongjie, et al. Incremental learning based on anchored class centers for SAR automatic target recognition[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5235313. doi: 10.1109/TGRS.2022.3208346. [40] XI Jiangbo, YAN Ziyun, JIANG Wandong, et al. Continual learning for scene classification of high resolution remote sensing images[C]. SPIE 12057, Twelfth International Conference on Information Optics and Photonics, Xi’an, China, 2021: 558–574. doi: 10.1117/12.2605919. [41] TANG Jiaxin, XIANG Deliang, ZHANG Fan, et al. Incremental SAR automatic target recognition with error correction and high plasticity[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2022, 15: 1327–1339. doi: 10.1109/JSTARS.2022.3141485. [42] XU Meng, ZHAO Yuanyuan, LIANG Yajun, et al. Hyperspectral image classification based on class-incremental learning with knowledge distillation[J]. Remote Sensing, 2022, 14(11): 2556. doi: 10.3390/rs14112556. [43] ZHOU Yongsheng, ZHANG Shuo, SUN Xiaokun, et al. SAR target incremental recognition based on hybrid loss function and class-bias correction[J]. Applied Sciences, 2022, 12(3): 1279. doi: 10.3390/app12031279. [44] HUANG Heqing, GAO Fei, WANG Jun, et al. An incremental SAR target recognition framework via memory-augmented weight alignment and enhancement discrimination[J]. IEEE Geoscience and Remote Sensing Letters, 2023, 20: 4005205. doi: 10.1109/LGRS.2023.3269480. [45] CHEN Xi, JIANG Jie, LI Zhiqiang, et al. An online continual object detector on VHR remote sensing images with class imbalance[J]. Engineering Applications of Artificial Intelligence, 2023, 117: 105549. doi: 10.1016/j.engappai.2022.105549. [46] ZHENG Zhi, NIE Xiangli, and ZHANG Bo. Fine-grained continual learning for SAR target recognition[C]. 2022 IEEE International Geoscience and Remote Sensing Symposium, Kuala Lumpur, Malaysia, 2022: 2207–2210. doi: 10.1109/IGARSS46834.2022.9884149. [47] AMMOUR N. Continual learning using data regeneration for remote sensing scene classification[J]. IEEE Geoscience and Remote Sensing Letters, 2022, 19: 8012805. doi: 10.1109/LGRS.2021.3080036. [48] HINTON Geoffrey, VINYALS Oriol, and DEAN Jeff. Distilling the knowledge in a neural network[FR/OL]. https://arxiv.org/abs/1503.02531, 2014. [49] CHEN Jingzhou, WANG Shihao, CHEN Ling, et al. Incremental detection of remote sensing objects with feature pyramid and knowledge distillation[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5600413. doi: 10.1109/TGRS.2020.3042554. [50] YANG Naisen and TANG Hong. GeoBoost: An incremental deep learning approach toward global mapping of buildings from VHR remote sensing images[J]. Remote Sensing, 2020, 12(11): 1794. doi: 10.3390/rs12111794. [51] FRIEDMAN J H. Greedy function approximation: A gradient boosting machine[J]. The Annals of Statistics, 2001, 29(5): 1189–1232. doi: 10.1214/aos/1013203451. [52] WELLING M. Herding dynamical weights to learn[C]. The 26th Annual International Conference on Machine Learning, Montreal, Canada, 2009: 1121–1128. doi: 10.1145/1553374.1553517. [53] BHAT S D, BANERJEE B, CHAUDHURI S, et al. CILEA-NET: Curriculum-based incremental learning framework for remote sensing image classification[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2021, 14: 5879–5890. doi: 10.1109/JSTARS.2021.3084408. [54] OVEIS A H, GIUSTI E, GHIO S, et al. Incremental learning in synthetic aperture radar images using openmax algorithm[C]. 2023 IEEE Radar Conference, San Antonio, USA, 2023: 1–6. doi: 10.1109/RadarConf2351548.2023.10149627. [55] DANG Sihang, CAO Zongjie, CUI Zongyong, et al. Open set incremental learning for automatic target recognition[J]. IEEE Transactions on Geoscience and Remote Sensing, 2019, 57(7): 4445–4456. doi: 10.1109/TGRS.2019.2891266. [56] DANG Sihang, CUI Zongyong, CAO Zongjie, et al. Distribution reliability assessment-based incremental learning for automatic target recognition[J]. IEEE Transactions on Geoscience and Remote Sensing, 2023, 61: 5208413. doi: 10.1109/TGRS.2023.3277873. [57] LI Yuhua and MAGUIRE L. Selecting critical patterns based on local geometrical and statistical information[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2011, 33(6): 1189–1201. doi: 10.1109/TPAMI.2010.188. [58] GOODFELLOW I J, POUGET-ABADIE J, MIRZA M, et al. Generative adversarial nets[C]. The 27th International Conference on Neural Information Processing Systems, Montreal, Canada, 2014: 2672–2680. doi: 10.5555/2969033.2969125. [59] KINGMA D P and WELLING M. Auto-encoding variational Bayes[C]. The 2nd International Conference on Learning Representations, Banff, Canada, 2014: 1–14. [60] AMMOUR N. Memory using data generator in continual learning for remote sensing scene classification[C]. 2021 IEEE International Geoscience and Remote Sensing Symposium IGARSS, Brussels, Belgium, 2021: 4924–4927. doi: 10.1109/IGARSS47720.2021.9553520. [61] 李德仁, 张良培, 夏桂松. 遥感大数据自动分析与数据挖掘[J]. 测绘学报, 2014, 43(12): 1211–1216. doi: 10.13485/j.cnki.11-2089.2014.0187.LI Deren, ZHANG Liangpei, and XIA Guisong. Automatic analysis and mining of remote sensing big data[J]. Acta Geodaetica et Cartographica Sinica, 2014, 43(12): 1211–1216. doi: 10.13485/j.cnki.11-2089.2014.0187. [62] 龚健雅, 许越, 胡翔云, 等. 遥感影像智能解译样本库现状与研究[J]. 测绘学报, 2021, 50(8): 1013–1022. doi: 10.11947/j.AGCS.2021.20210085.GONG Jianya, XU Yue, HU Xianyun, et al. Status analysis and research of sample database for intelligent interpretation of remote sensing image[J]. Acta Geodaetica et Cartographica Sinica, 2021, 50(8): 1013–1022. doi: 10.11947/j.AGCS.2021.20210085. [63] AMMOUR N, BAZI Y, ALHICHRI H, et al. Continual learning approach for remote sensing scene classification[J]. IEEE Geoscience and Remote Sensing Letters, 2022, 19: 8000905. doi: 10.1109/LGRS.2020.3019071. [64] ZHAO Ling, XU Linrui, ZHAO Li, et al. Continual learning for remote sensing image scene classification with prompt learning[J]. IEEE Geoscience and Remote Sensing Letters, 2023, 20: 6012005. doi: 10.1109/LGRS.2023.3328981. [65] YE Dingqi, PENG Jian, LI Haifeng, et al. Better memorization, better recall: A lifelong learning framework for remote sensing image scene classification[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5626814. doi: 10.1109/TGRS.2022.3190392. [66] LI Junxi, SUN Xian, DIAO Wenhui, et al. Class-incremental learning network for small objects enhancing of semantic segmentation in aerial imagery[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5612920. doi: 10.1109/TGRS.2021.3124303. [67] TASAR O, TARABALKA Y, and ALLIEZ P. Incremental learning for semantic segmentation of large-scale remote sensing data[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2019, 12(9): 3524–3537. doi: 10.1109/JSTARS.2019.2925416. [68] WANG Zifeng, ZHANG Zizhao, LEE C, et al. Learning to prompt for continual learning[C]. 2022 IEEE/CVF Conference on Computer Vision and Pattern Recognition, New Orleans, USA, 2022: 139–149. doi: 10.1109/CVPR52688.2022.00024. [69] TASAR O, TARABALKA Y, and ALLIEZ P. Continual learning for dense labeling of satellite images[C]. 2019 IEEE International Geoscience and Remote Sensing Symposium, Yokohama, Japan, 2019: 4943–4946. doi: 10.1109/IGARSS.2019.8898615. [70] CHENG Gong, HAN Junwei, and LU Xiaoqiang. Remote sensing image scene classification: Benchmark and state of the art[J]. Proceedings of the IEEE, 2017, 105(10): 1865–1883. doi: 10.1109/JPROC.2017.2675998. [71] DI Yanghua, JIANG Zhiguo, and ZHANG Haopeng. A public dataset for fine-grained ship classification in optical remote sensing images[J]. Remote Sensing, 2021, 13(4): 747. doi: 10.3390/rs13040747. [72] ZHOU Weixun, NEWSAM S, LI Congmin, et al. PatternNet: A benchmark dataset for performance evaluation of remote sensing image retrieval[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2018, 145: 197–209. doi: 10.1016/j.isprsjprs.2018.01.004. [73] LI Haifeng, JIANG Hao, GU Xin, et al. CLRS: Continual learning benchmark for remote sensing image scene classification[J]. Sensors, 2020, 20(4): 1226. doi: 10.3390/s20041226. [74] WANG Qi, LIU Shaoteng, CHANUSSOT J, et al. Scene classification with recurrent attention of VHR remote sensing images[J]. IEEE Transactions on Geoscience and Remote Sensing, 2019, 57(2): 1155–1167. doi: 10.1109/TGRS.2018.2864987. [75] XIA Guisong, HU Jingwen, HU Fan, et al. AID: A benchmark data set for performance evaluation of aerial scene classification[J]. IEEE Transactions on Geoscience and Remote Sensing, 2017, 55(7): 3965–3981. doi: 10.1109/TGRS.2017.2685945. [76] LI Haifeng, DOU Xin, TAO Chao, et al. RSI-CB: A large-scale remote sensing image classification benchmark using crowdsourced data[J]. Sensors, 2020, 20(6): 1594. doi: 10.3390/s20061594. [77] YANG Yi and NEWSAM S. Bag-of-visual-words and spatial extensions for land-use classification[C]. The 18th SIGSPATIAL International Conference on Advances in Geographic Information Systems, San Jose, USA, 2010: 270–279. doi: 10.1145/1869790.1869829. [78] ZHAO Bei, ZHONG Yanfei, XIA Guisong, et al. Dirichlet-derived multiple topic scene classification model for high spatial resolution remote sensing imagery[J]. IEEE Transactions on Geoscience and Remote Sensing, 2016, 54(4): 2108–2123. doi: 10.1109/TGRS.2015.2496185. [79] LI Ke, WAN Gang, CHENG Gong, et al. Object detection in optical remote sensing images: A survey and a new benchmark[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2020, 159: 296–307. doi: 10.1016/j.isprsjprs.2019.11.023. [80] XIA Guisong, BAI Xiang, DING Jian, et al. DOTA: A large-scale dataset for object detection in aerial images[C]. 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition, Salt Lake City, USA, 2018: 3974–3983. doi: 10.1109/CVPR.2018.00418. [81] CHENG Gong, HAN Junwei, ZHOU Peicheng, et al. Multi-class geospatial object detection and geographic image classification based on collection of part detectors[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2014, 98: 119–132. doi: 10.1016/j.isprsjprs.2014.10.002. [82] WAQAS ZAMIR S, ARORA A, GUPTA A, et al. ISAID: A large-scale dataset for instance segmentation in aerial images[C]. IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops, Long Beach, USA, 2019: 28–37. [83] SUN Xian, WANG Peijin, YAN Zhiyuan, et al. Automated high-resolution earth observation image interpretation: Outcome of the 2020 Gaofen challenge[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2021, 14: 8922–8940. doi: 10.1109/JSTARS.2021.3106941. [84] International Society for Photogrammetry and Remote Sensing. 2D semantic labeling contest–Potsdam[EB/OL]. https://www.isprs.org/education/benchmarks/UrbanSemLab/2d-sem-label-potsdam.aspx, 2024. [85] International Society for Photogrammetry and Remote Sensing. 2D semantic labeling-Vaihingen data[EB/OL]. https://www.isprs.org/education/benchmarks/UrbanSemLab/2d-sem-label-vaihingen.aspx, 2024. [86] DEMIR I, KOPERSKI K, LINDENBAUM D, et al. DeepGlobe 2018: A challenge to parse the earth through satellite images[C]. Proceedings of 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops, Salt Lake City, USA, 2018: 172–181. doi: 10.1109/CVPRW.2018.00031. [87] 李雪, 姚光乐, 王洪辉, 等. 基于样本增量学习的遥感影像分类[J]. 计算机应用, 2024, 44(3): 732–736. doi: 10.11772/j.issn.1001-9081.2023030366.LI Xue, YAO Guangle, WANG Honghui, et al. Remote sensing image classification based on sample incremental learning[J]. Journal of Computer Applications, 2024, 44(3): 732–736. doi: 10.11772/j.issn.1001-9081.2023030366. [88] WANG Ming, YU Dayu, HE Wanting, et al. Domain-incremental learning for fire detection in space-air-ground integrated observation network[J]. International Journal of Applied Earth Observation and Geoinformation, 2023, 118: 103279. doi: 10.1016/j.jag.2023.103279. [89] SHI Qian, LIU Mengxi, LI Shengchen, et al. A deeply supervised attention metric-based network and an open aerial image dataset for remote sensing change detection[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5604816. doi: 10.1109/TGRS.2021.3085870. [90] LEBEDEV M A, VIZILTER Y V, VYGOLOV O V, et al. Change detection in remote sensing images using conditional adversarial networks[J]. The International Archives of the Photogrammetry, Remote Sensing and Spatial Information Sciences, 2018, XLII-2: 565–571. doi: 10.5194/isprs-archives-XLII-2-565-2018. [91] WANG Ming, JIANG Liangcun, YUE Peng, et al. FASDD: An open-access 100, 000-level flame and smoke detection dataset for deep learning in fire detection[J]. Earth System Science Data. doi: 10.5194/essd-2023-73. [92] SHAMSOSHOARA A, AFGHAH F, RAZI A, et al. Aerial imagery pile burn detection using deep learning: The FLAME dataset[J]. Computer Networks, 2021, 193: 108001. doi: 10.1016/j.comnet.2021.108001. [93] GUPTA R, GOODMAN B, PATEL N, et al. Creating xBD: A dataset for assessing building damage from satellite imagery[C]. IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops, Long Beach, USA, 2019: 10–17. [94] SUMBUL G, CHARFUELAN M, DEMIR B, et al. Bigearthnet: A large-scale benchmark archive for remote sensing image understanding[C]. 2019 IEEE International Geoscience and Remote Sensing Symposium, Yokohama, Japan, 2019: 5901–5904. doi: 10.1109/IGARSS.2019.8900532. [95] HELBER P, BISCHKE B, DENGEL A, et al. EuroSAT: A novel dataset and deep learning benchmark for land use and land cover classification[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2019, 12(7): 2217–2226. doi: 10.1109/JSTARS.2019.2918242. [96] ZHAO Lijun, TANG Ping, and HUO Lianzhi. Feature significance-based multibag-of-visual-words model for remote sensing image scene classification[J]. Journal of Applied Remote Sensing, 2016, 10(3): 035004. doi: 10.1117/1.JRS.10.035004. [97] ZOU Qin, NI Lihao, ZHANG Tong, et al. Deep learning based feature selection for remote sensing scene classification[J]. IEEE Geoscience and Remote Sensing Letters, 2015, 12(11): 2321–2325. doi: 10.1109/LGRS.2015.2475299. [98] BASU S, GANGULY S, MUKHOPADHYAY S, et al. DeepSat: A learning framework for satellite imagery[C]. The 23rd SIGSPATIAL International Conference on Advances in Geographic Information Systems, Seattle, USA, 2015: 37. doi: 10.1145/2820783.2820816. [99] TONG Xinyi, XIA Guisong, LU Qikai, et al. Land-cover classification with high-resolution remote sensing images using transferable deep models[J]. Remote Sensing of Environment, 2020, 237: 111322. doi: 10.1016/j.rse.2019.111322. [100] 第八届中国计算机学会大数据与计算智能大赛. 遥感影像地块分割数据集[EB/OL]. https://www.datafountain.cn/competitions/475, 2020.The 8th CCF Big Data and Computing Intelligence Contest. Remote sensing image segmentation dataset[EB/OL]. https://www.datafountain.cn/competitions/475, 2020. [101] WANG Junjue, ZHENG Zhuo, MA Ailong, et al. LoveDA: A remote sensing land-cover dataset for domain adaptive semantic segmentation[C/OL]. The 35th Conference on Neural Information Processing Systems Track on Datasets and Benchmarks, 2021: 1–12. [102] MA Xiaojie, JI Kefeng, FENG Sijia, et al. Open set recognition with incremental learning for SAR target classification[J]. IEEE Transactions on Geoscience and Remote Sensing, 2023, 61: 5106114. doi: 10.1109/TGRS.2023.3283423. [103] KEYDEL E R, LEE S W, and MOORE J T. Mstar extended operating conditions: A tutorial[C]. SPIE 2757, Algorithms for Synthetic Aperture Radar Imagery III, Orlando, USA, 1996: 228–242. doi: 10.1117/12.242059. [104] HUANG Lanqing, LIU Bin, LI Boying, et al. OpenSARship: A dataset dedicated to sentinel-1 ship interpretation[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2018, 11(1): 195–208. doi: 10.1109/JSTARS.2017.2755672. [105] BAI Jing, YUAN Anran, XIAO Zhu, et al. Class incremental learning with few-shots based on linear programming for hyperspectral image classification[J]. IEEE Transactions on Cybernetics, 2022, 52(6): 5474–5485. doi: 10.1109/TCYB.2020.3032958. [106] ZHAO Wenzhi, PENG Rui, WANG Qiao, et al. Life-long learning with continual spectral-spatial feature distillation for hyperspectral image classification[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5544214. doi: 10.1109/TGRS.2022.3222520. [107] GRAÑA M, VEGANZONS M A, and AYERDI B. Hyperspectral remote sensing scenes: Pavia Centre and university[EB/OL]. https://www.ehu.eus/ccwintco/index.php/Hyperspectral_Remote_Sensing_Scenes#Pavia_Centre_and_University, 2024. [108] GRAÑA M, VEGANZONS M A, and AYERDI B. Hyperspectral remote sensing scenes: Salinas[EB/OL]. https://www.ehu.eus/ccwintco/index.php/Hyperspectral_Remote_Sensing_Scenes#Salinas, 2024. [109] The National Center for Airborne Laser Mapping. 2013 IEEE GRSS data fusion contest-fusion of hyperspectral and LiDAR data[EB/OL]. https://hyperspectral.ee.uh.edu/?page_id, 2024. [110] BAUMGARDNER M F, BIEHL L L, and LANDGREBE D A. 220 band aviris hyperspectral image data set: June 12, 1992 Indian pine test site 3[EB/OL]. https://purr.purdue.edu/publications/1947/1, 2015. [111] LENCZNER G, CHAN-HON-TONG A, LUMINARI N, et al. Weakly-supervised continual learning for class-incremental segmentation[C]. 2022 IEEE International Geoscience and Remote Sensing Symposium, Kuala Lumpur, Malaysia, 2022: 4843–4846. doi: 10.1109/IGARSS46834.2022.9884547. [112] ZHU Zining, WANG Peijin, DIAO Wenhui, et al. Few-shot incremental learning with continual prototype calibration for remote sensing image fine-grained classification[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2023, 196: 210–227. doi: 10.1016/j.isprsjprs.2022.12.024. [113] ZHAO Yan, ZHAO Lingjun, DING Ding, et al. Few-shot class-incremental SAR target recognition via cosine prototype learning[J]. IEEE Transactions on Geoscience and Remote Sensing, 2023, 61: 5212718. doi: 10.1109/TGRS.2023.3298016. [114] WANG Li, YANG Xinyao, TAN Haoyue, et al. Few-shot class-incremental SAR target recognition based on hierarchical embedding and incremental evolutionary network[J]. IEEE Transactions on Geoscience and Remote Sensing, 2023, 61: 5204111. doi: 10.1109/TGRS.2023.3248040. [115] XU Zekai, ZHANG Mingyi, HOU Jiayue, et al. Delving into transformer for incremental semantic segmentation[EB/OL]. https://arxiv.org/abs/2211.10253, 2022. -

下载:

下载:

下载:

下载: