A SAR Image Aircraft Target Detection and Recognition Network with Target Region Feature Enhancement

-

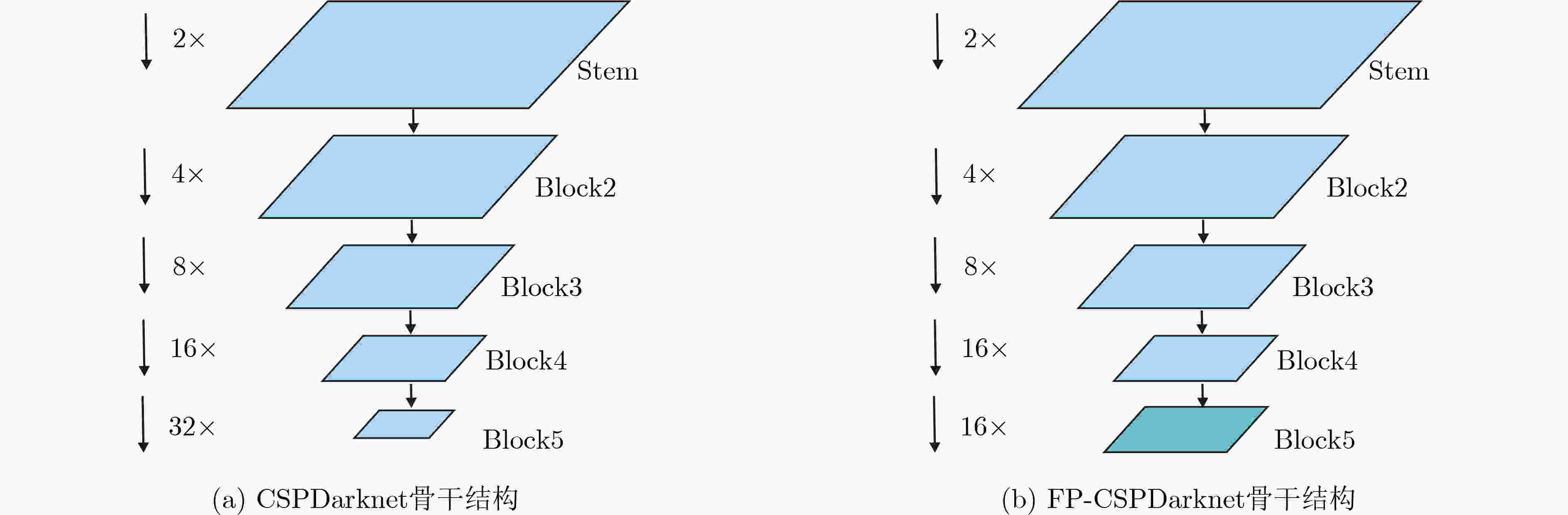

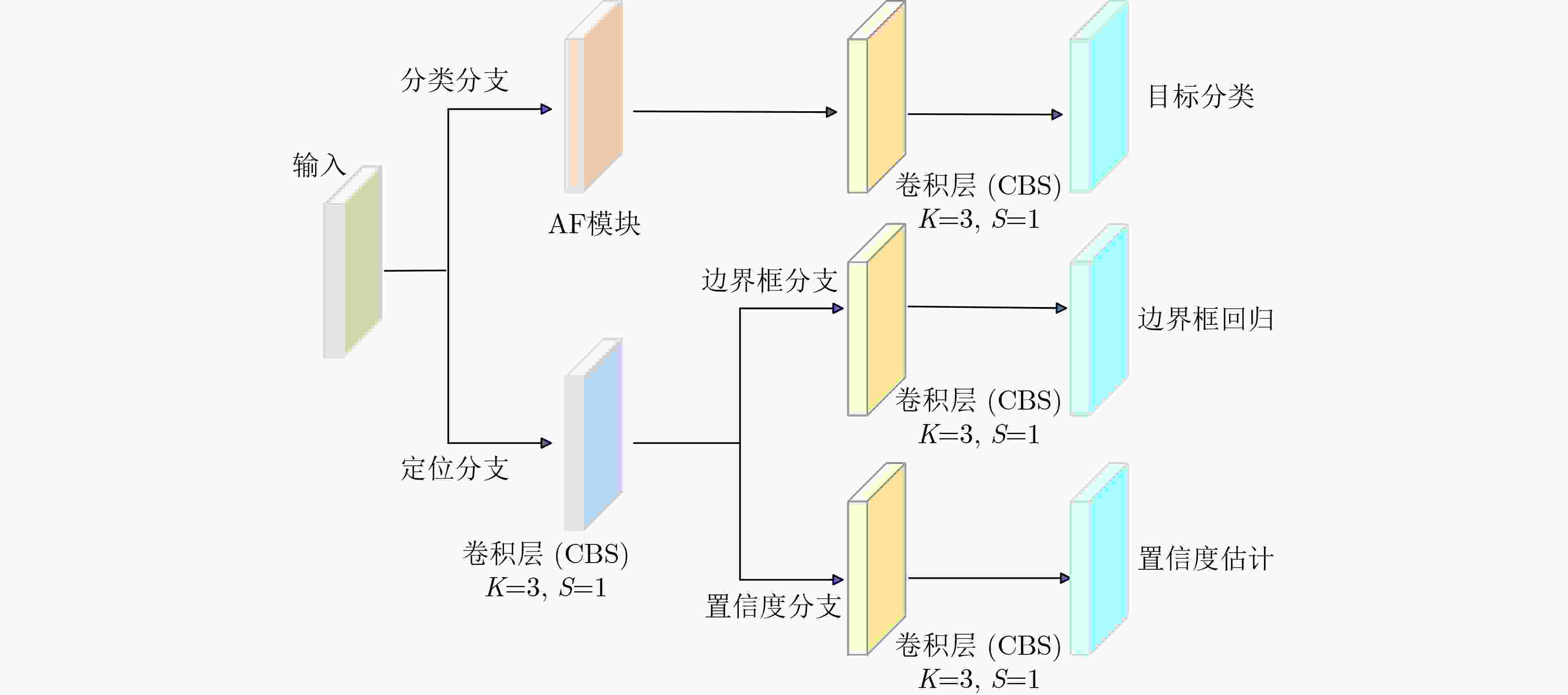

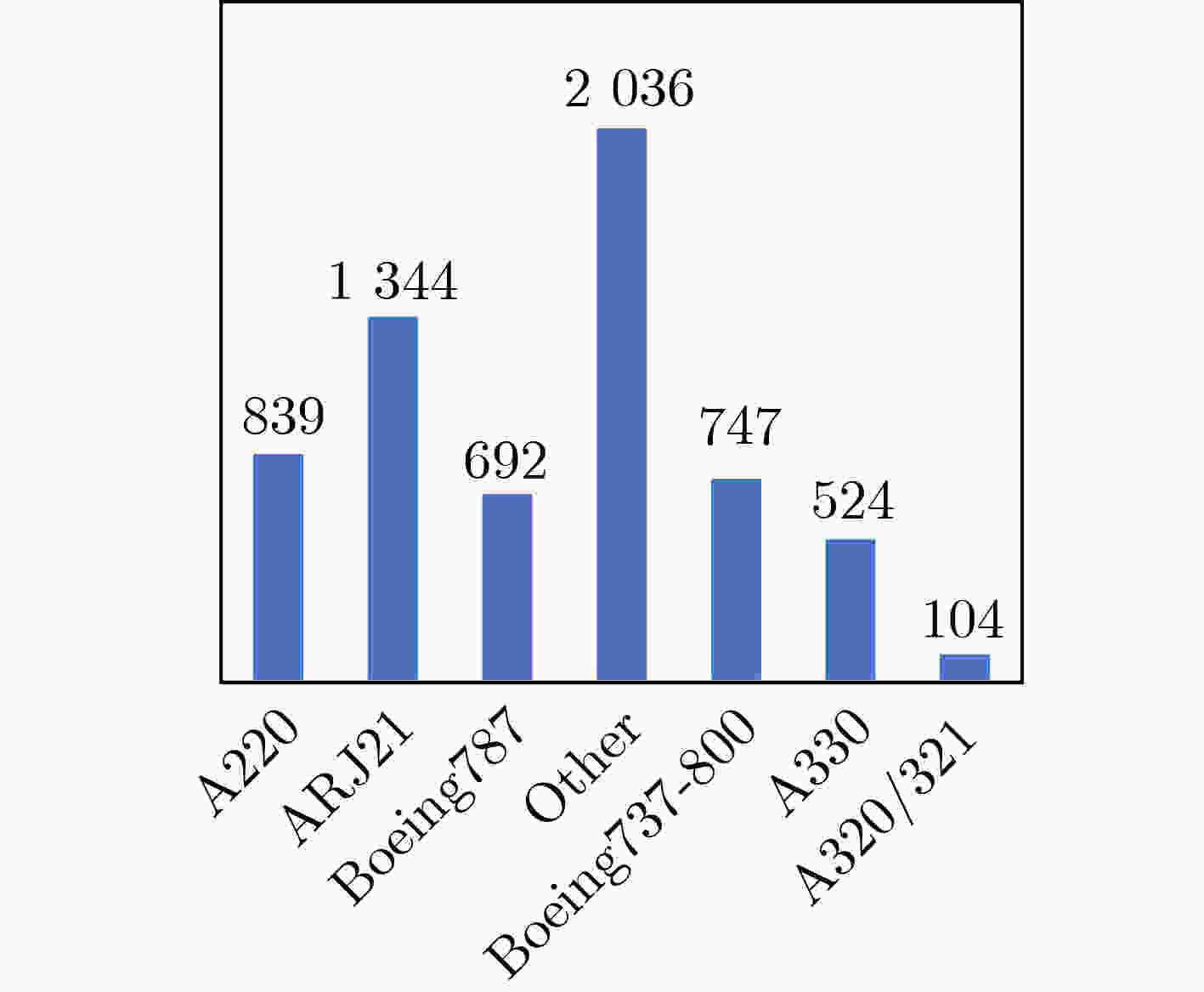

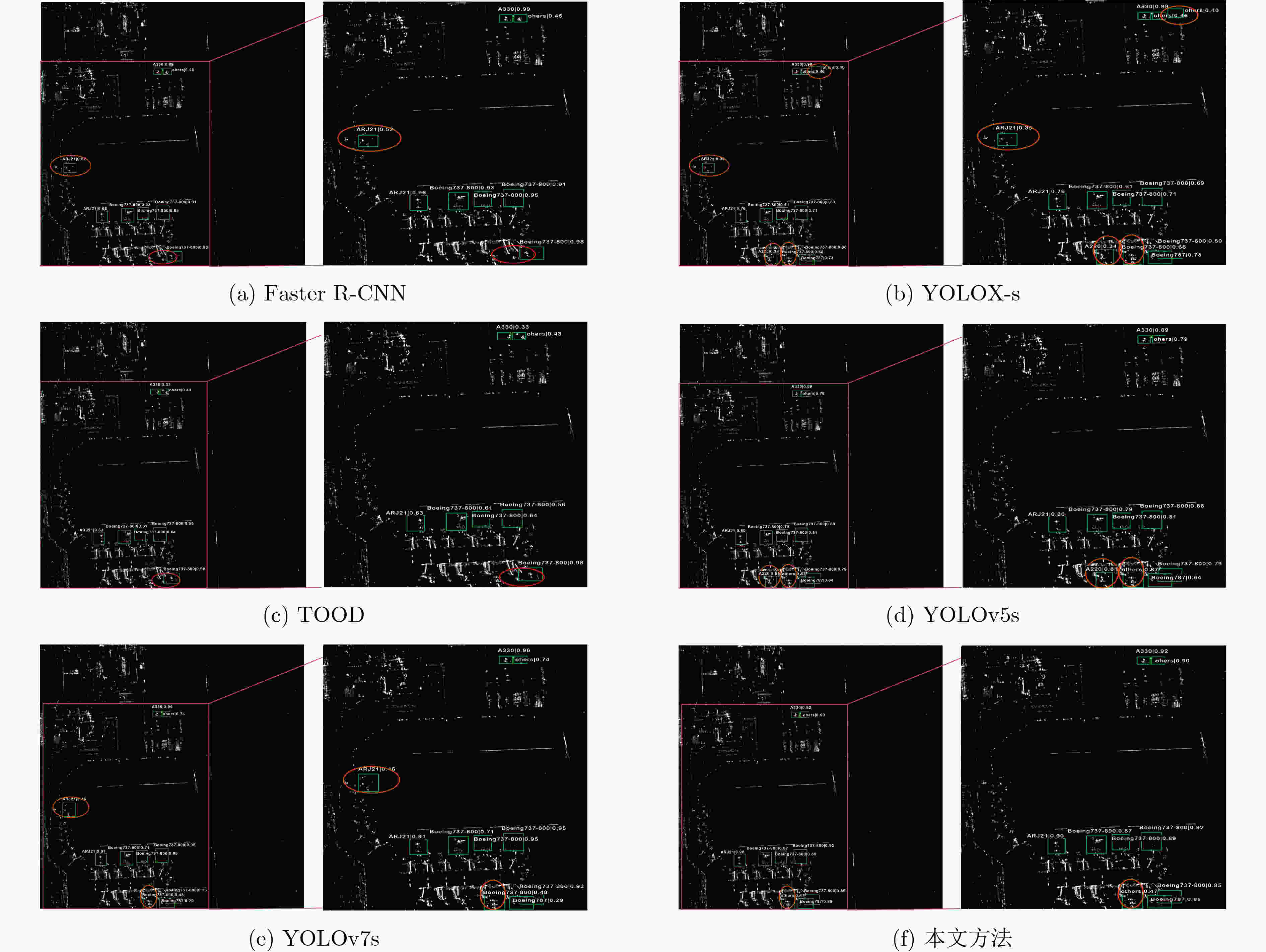

摘要: 在合成孔径雷达(SAR)图像飞机目标检测识别中,飞机目标图像呈现离散特性以及结构之间的相似性会降低飞机检测与识别的准确率。为此该文设计了一种目标区域特征增强的SAR图像飞机目标检测与识别网络。网络由3部分组成:保护飞机特征的跨阶段部分网络(FP-CSPDarnet)、自适应特征融合的特征金字塔(FPN-A)以及目标区域散射特征提取与增强的检测头(D-Head)。FP-CSPDarnet在提取特征的同时可以有效保护SAR图像飞机特征;FPN-A采用多层次特征自适应融合、细化,来增强飞机特征;D-Head在检测前有效增强飞机可辨别特征,提升飞机检测与识别精度。利用SAR-ADRD数据集的实验结果证明了该文所提方法有效性,其平均精度相对与基线网络YOLOv5s提升了2.0%。Abstract: In Synthetic Aperture Radar (SAR) image aircraft target detection and recognition, the discrete characteristics of aircraft target images and the similarity between structures can reduce the accuracy of aircraft detection and recognition. A SAR image aircraft target detection and recognition network with enhanced target area features is proposed in this paper. The network consists of three parts: Feature Protecting Cross Stage Partial Darknet (FP-CSPDarnet) for protecting aircraft features, Feature Pyramid Net with Adaptive fusion (FPN-A) for adaptive feature fusion, and Detection Head for target area scattering feature extraction and enhancement (D-Head). FP-CSPDarnet can effectively protect the aircraft features in SAR images while extracting features; FPN-A adopts multi-level feature adaptive fusion and refinement to enhance aircraft features; D-Head effectively enhances the identifiable features of the aircraft before detection, improving the accuracy of aircraft detection and recognition. The experimental results using the SAR-ADRD dataset have demonstrated the effectiveness of the proposed method, with an average accuracy improvement of 2.0% compared to the baseline network YOLOv5s.

-

表 1 YOLOv5网络深度消融实验

模型 P(%) R(%) mAP(%) Parameters(M) fps YOLOv5n 90.6 89.1 92.0 1.8 93.6 YOLOv5s 93.0 90.6 93.7 7.0 93.5 YOLOv5m 92.2 90.2 93.3 20.9 68.5 YOLOv5l 93.1 91.2 93.0 46.1 47.6 YOLOv5x 94.0 91.0 94.4 86.2 41.9 表 2 网络各个模块消融实验

FPN-A FP-CSPDarnet D-Head P(%) R(%) mAP(%) Parameters(M) fps Baseline – – – 93.0 90.6 93.7 7.0 93.6 √ – – 90.2 86.5 92.4 8.5 129.9 √ √ – 92.3 92.5 94.8 10.3 129.9 本文方法 √ √ √ 92.5 92.3 95.7 12.2 108.7 表 3 骨干网络P-CSPDarknet中各模块消融实验(%)

FPN-A FP-CSPDarnet (骨干结构) FP-CSPDarnet (骨干结构+SPD-Conv) P (%) R (%) mAP √ – – 90.2 86.5 92.4 √ √ – 91.8 90.2 93.9 √ √ √ 92.3 92.5 94.8 表 4 不同检测网络对比实验

P(%) R(%) mAP(%) Parameters(M) fps YOLOv5s 92.6 89.9 93.7 7.0 93.5 Faster R-CNN 82.0 85.6 87.8 41.2 11.2 TOOD 84.9 81.7 85.0 31.8 12.9 YOLOX-s 80.7 83.4 89.7 8.9 41.2 YOLOv7s 91.1 87.6 93.5 9.2 75.8 本文方法 92.5 92.3 95.7 12.3 108.7 表 5 数据集内不同飞机类别在不同检测网络的精度(%)

网络模型/飞机类别 Boeing787 A220 ARJ21 Boeing737-800 A320/321 A330 Others mAP(%) YOLOv5s 98.0 96.6 93.6 87.2 88.1 95.1 96.9 93.7 Yolov7s 96.8 95.5 92.2 93.0 85.8 96.2 94.2 93.5 TOOD 90.7 94.3 85.3 81.1 67.8 91.0 84.4 84.9 YOLOX-s 89.2 86.4 86.3 94.5 95.4 86.7 89.5 89.7 Faster R-CNN 91.8 94.8 87.9 85.6 74.7 91.1 89.0 87.8 本文方法 98.7 98.7 97.7 95.1 95.4 94.8 97.1 95.7 -

[1] 高贵, 周蝶飞, 蒋咏梅, 等. SAR图像目标检测研究综述[J]. 信号处理, 2008, 24(6): 971–981. doi: 10.3969/j.issn.1003-0530.2008.06.018.GAO Gui, ZHOU Diefei, JIANG Yongmei, et al. Study on target detection in SAR Image: A survey[J]. Signal Processing, 2008, 24(6): 971–981. doi: 10.3969/j.issn.1003-0530.2008.06.018. [2] 李永祯, 黄大通, 邢世其, 等. 合成孔径雷达干扰技术研究综述[J]. 雷达学报, 2020, 9(5): 753–764. doi: 10.12000/JR20087.LI Yongzhen, HUANG Datong, XING Shiqi, et al. A review of synthetic aperture radar jamming technique[J]. Journal of Radars, 2020, 9(5): 753–764. doi: 10.12000/JR20087. [3] FU Kun, DOU Fangzheng, LI Hengchao, et al. Aircraft recognition in SAR images based on scattering structure feature and template matching[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2018, 11(11): 4206–4217. doi: 10.1109/JSTARS.2018.2872018. [4] HU Hao, HUANG Lanqing, and YU Wenxian. Aircraft detection for HR SAR Images in non-homogeneous background using GGMD-based modeling[J]. Chinese Journal of Electronics, 2019, 28(6): 1271–1280. doi: 10.1049/cje.2019.08.010. [5] CHEN Jiehong, ZHANG Bo, and WANG Chao. Backscattering feature analysis and recognition of civilian aircraft in TerraSAR-X images[J]. IEEE Geoscience and Remote Sensing Letters, 2015, 12(4): 796–800. doi: 10.1109/LGRS.2014.2362845. [6] HE Chu, TU Mingxia, LIU Xinlong, et al. Mixture statistical distribution based multiple component model for target detection in high resolution SAR imagery[J]. ISPRS International Journal of Geo-Information, 2017, 6(11): 336. doi: 10.3390/ijgi6110336. [7] 高君, 高鑫, 孙显. 基于几何特征的高分辨率SAR图像飞机目标解译方法[J]. 国外电子测量技术, 2015, 34(8): 21–28. doi: 10.3969/j.issn.1002-8978.2015.08.008.GAO Jun, GAO Xin, and SUN Xian. Geometrical features-based method for aircraft target interpretation in high-resolution SAR images[J]. Foreign Electronic Measurement Technology, 2015, 34(8): 21–28. doi: 10.3969/j.issn.1002-8978.2015.08.008. [8] ZHANG Peng, XU Hao, TIAN Tian, et al. SFRE-net: Scattering feature relation enhancement network for aircraft detection in SAR images[J]. Remote Sensing, 2022, 14(9): 2076. doi: 10.3390/rs14092076. [9] 赵琰. 基于深度学习的SAR图像飞机目标检测与识别[D]. [硕士论文], 国防科技大学, 2020. doi: 10.27052/d.cnki.gzjgu.2020.001038.ZHAO Yan. Deep learning based aircraft detection and recognition in SAR images[D]. [Master dissertation], National University of Defense Technology, 2020. doi: 10.27052/d.cnki.gzjgu.2020.001038. [10] WANG Zhen, XU Nan, GUO Jianxin, et al. SCFNet: Semantic condition constraint guided feature aware network for aircraft detection in SAR Images[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5239420. doi: 10.1109/TGRS.2022.3224599. [11] 王智睿, 康玉卓, 曾璇, 等. SAR-AIRcraft-1.0: 高分辨率SAR飞机检测识别数据集[J]. 雷达学报, 2023, 12(4): 906–922. doi: 10.12000/JR23043.WANG Zhirui, KANG Yuzhuo, ZENG Xuan, et al. SAR-AIRcraft-1.0: High-resolution SAR aircraft detection and recognition dataset[J]. Journal of Radars, 2023, 12(4): 906–922. doi: 10.12000/JR23043. [12] WU Wentong, LIU Han, LI Lingling, et al. Application of local fully convolutional neural network combined with YOLO v5 algorithm in small target detection of remote sensing image[J]. PLoS One, 2021, 16(10): e0259283. doi: 10.1371/journal.pone.0259283. [13] LIN T Y, DOLLÁR P, GIRSHICK R, et al. Feature pyramid networks for object detection[C]. 2017 IEEE Conference on Computer Vision and Pattern Recognition, Hawaii, American, 2017: 2117–2125. doi: 10.1109/CVPR.2017.106. [14] CHEN Qiang, WANG Yingming, YANG Tong, et al. You only look one-level feature[C]. 2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition, Nashville, USA, 2021: 13039–13048. doi: 10.1109/CVPR46437.2021.01284. [15] SONG Guanglu, LIU Yu, and WANG Xiaogang. Revisiting the sibling head in object detector[C]. 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition, Seattle, American, 2020: 11563–11572. doi: 10.1109/CVPR42600.2020.01158. [16] ZHUANG Jiayuan, QIN Zheng, YU Hao, et al. Task-specific context decoupling for object detection[J]. arXiv preprint arXiv: 2303.01047, 2023. [17] GE Zhang, LIU Songtao, WANG Feng, et al. YOLOX: Exceeding YOLO series in 2021[J]. arXiv preprint arXiv: 2107.08430, 2021. [18] FENG Chengjian, ZHONG Yujie, GAO Yu, et al. TOOD: Task-aligned one-stage object detection[C]. 2021 IEEE/CVF International Conference on Computer Vision, Montreal, Canada, 2021: 3490–3499. doi: 10.1109/ICCV48922.2021.00349. [19] LI Chuyi, LI Lulu, JIANG Hongliang, et al. YOLOv6: A single-stage object detection framework for industrial applications[J]. arXiv preprint arXiv: 2209.02976, 2022. [20] WANG Gang, CHEN Yanfei, AN Pei, et al. UAV-YOLOv8: A small-object-detection model based on improved YOLOv8 for UAV aerial photography scenarios[J]. Sensors, 2023, 23(16): 7190. doi: 10.3390/s23167190. [21] ZHAO Yan, ZHAO Lingjun, LIU Zhong, et al. Attentional feature refinement and alignment network for aircraft detection in SAR imagery[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5220616. doi: 10.1109/TGRS.2021.3139994. [22] HAN Ping, LIAO Dayu, HAN Binbin, et al. SEAN: A simple and efficient attention network for aircraft detection in SAR images[J]. Remote Sensing, 2022, 14(18): 4669. doi: 10.3390/rs14184669. [23] REN Shaoqing, HE Kaiming, GIRSHICK R, et al. Faster R-CNN: Towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6): 1137–1149. doi: 10.1109/TPAMI.2016.2577031. [24] WANG C Y, BOCHKOVSKIY A, and LIAO H Y M. YOLOv7: Trainable bag-of-freebies sets new state-of-the-art for real-time object detectors[C]. 2023 IEEE/CVF Conference on Computer Vision and Pattern Recognition, Vancouver, Canada, 2023: 7464–7475. doi: 10.1109/CVPR52729.2023.00721. -

下载:

下载:

下载:

下载: