| [1] |

STOYANOVA M, NIKOLOUDAKIS Y, PANAGIOTAKIS S, et al. A survey on the internet of things (IoT) forensics: Challenges, approaches, and open issues[J]. IEEE Communications Surveys & Tutorials, 2020, 22(2): 1191–1221. doi: 10.1109/COMST.2019.2962586

|

| [2] |

JAVADI S H. Detection over sensor networks: A tutorial[J]. IEEE Aerospace and Electronic Systems Magazine, 2016, 31(3): 2–18. doi: 10.1109/MAES.2016.140128

|

| [3] |

ARAD J, HOUSH M, PERELMAN L, et al. A dynamic thresholds scheme for contaminant event detection in water distribution systems[J]. Water Research, 2013, 47(5): 1899–1908. doi: 10.1016/j.watres.2013.01.017

|

| [4] |

LIU Li, HAN Guangjie, HE Yu, et al. Fault-tolerant event region detection on trajectory pattern extraction for industrial wireless sensor networks[J]. IEEE Transactions on Industrial Informatics, 2020, 16(3): 2072–2080. doi: 10.1109/TII.2019.2933238

|

| [5] |

YU Manzhu, BAMBACUS M, CERVONE G, et al. Spatiotemporal event detection: A review[J]. International Journal of Digital Earth, 2020, 13(12): 1339–1365. doi: 10.1080/17538947.2020.1738569

|

| [6] |

YIN Jie, HU D H, and YANG Qiang. Spatio-temporal event detection using dynamic conditional random fields[C]. The 21st International Joint Conference on Artificial Intelligence, Pasadena, USA, 2009: 1321–1326.

|

| [7] |

GRANJON P. The CuSum algorithm-a small review[EB/OL].https://hal.archives-ouvertes.fr/hal-00914697, 2013.

|

| [8] |

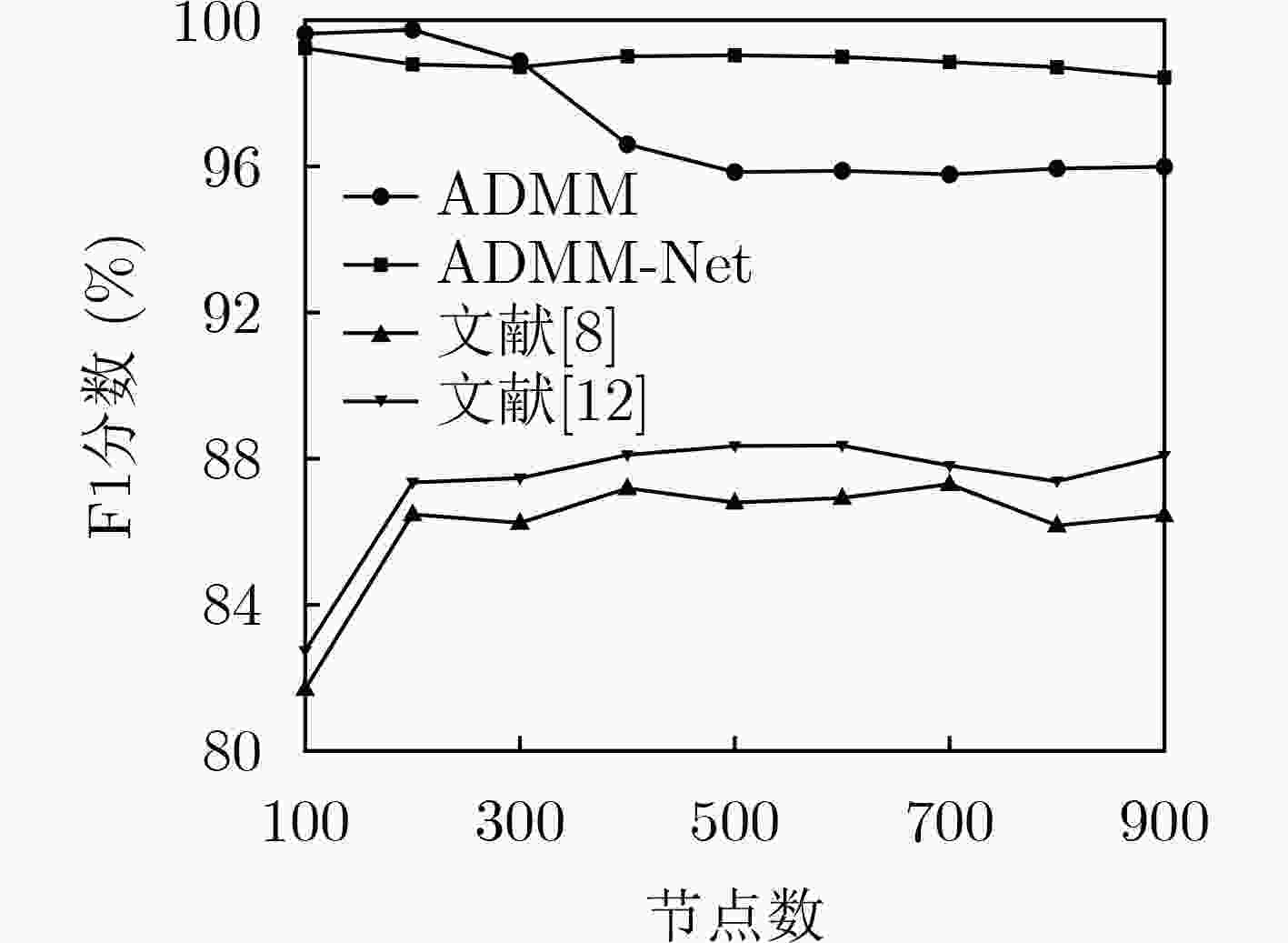

KRISHNAMACHARIB and IYENGAR S. Distributed Bayesian algorithms for fault-tolerant event region detection in wireless sensor networks[J]. IEEE Transactions on Computers, 2004, 53(3): 241–250. doi: 10.1109/TC.2004.1261832

|

| [9] |

CHEN Xianda, KIM K T, and YOUN H Y. Integration of Markov random field with Markov chain for efficient event detection using wireless sensor network[J]. Computer Networks, 2016, 108: 108–119. doi: 10.1016/j.comnet.2016.07.004

|

| [10] |

WU Tao and CHENG Qi. Online dynamic event region detection using distributed sensor networks[J]. IEEE Transactions on Aerospace and Electronic Systems, 2014, 50(1): 393–405. doi: 10.1109/TAES.2013.120308

|

| [11] |

WANG T Y, YANG M H, and WU J Y. Distributed detection of dynamic event regions in sensor networks with a Gibbs field distribution and Gaussian corrupted measurements[J]. IEEE Transactions on Communications, 2016, 64(9): 3932–3945. doi: 10.1109/TCOMM.2016.2593467

|

| [12] |

WANG Jiejie and LIU Bin. Online fault-tolerant dynamic event region detection in sensor networks via trust model[C]. 2017 IEEE Wireless Communications and Networking Conference (WCNC), San Francisco, USA, 2017: 1–6.

|

| [13] |

CANDÈS E J, LI Xiaodong, MA Yi, et al. Robust principal component analysis?[J]. Journal of the ACM, 2011, 58(3): 11. doi: 10.1145/1970392.1970395

|

| [14] |

GAO Lianru, HONG Danfeng, YAO Jing, et al. Spectral superresolution of multispectral imagery with joint sparse and low-rank learning[J]. IEEE Transactions on Geoscience and Remote Sensing, 2021, 59(3): 2269–2280. doi: 10.1109/TGRS.2020.3000684

|

| [15] |

MONGA V, LI Yuelong, and ELDAR Y C. Algorithm unrolling: Interpretable, efficient deep learning for signal and image processing[J]. IEEE Signal Processing Magazine, 2021, 38(2): 18–44. doi: 10.1109/MSP.2020.3016905

|

| [16] |

JOHNSTON J, LI Yinchuan, LOPS M, et al. ADMM-Net for communication interference removal in stepped-frequency radar[J]. IEEE Transactions on Signal Processing, 2021, 69: 2818–2832. doi: 10.1109/TSP.2021.3076900

|

| [17] |

YANG Liu, WANG Haifeng, and QIAN Hua. An ADMM-ResNet for data recovery in wireless sensor networks with guaranteed convergence[J]. Digital Signal Processing, 2021, 111: 102956. doi: 10.1016/j.dsp.2020.102956

|

| [18] |

AYBAT N S and IYENGAR G. An alternating direction method with increasing penalty for stable principal component pursuit[J]. Computational Optimization and Applications, 2015, 61(3): 635–668. doi: 10.1007/s10589-015-9736-6

|

| [19] |

Intel Berkeley Research Lab. Intel lab data[EB/OL]. http://db.lcs.mit.edu/labdata/labdata.html, 2019.

|

下载:

下载:

下载:

下载: