The Recommender System of Cross-border E-commerce Based on Heterogeneous Graph Neural Network

-

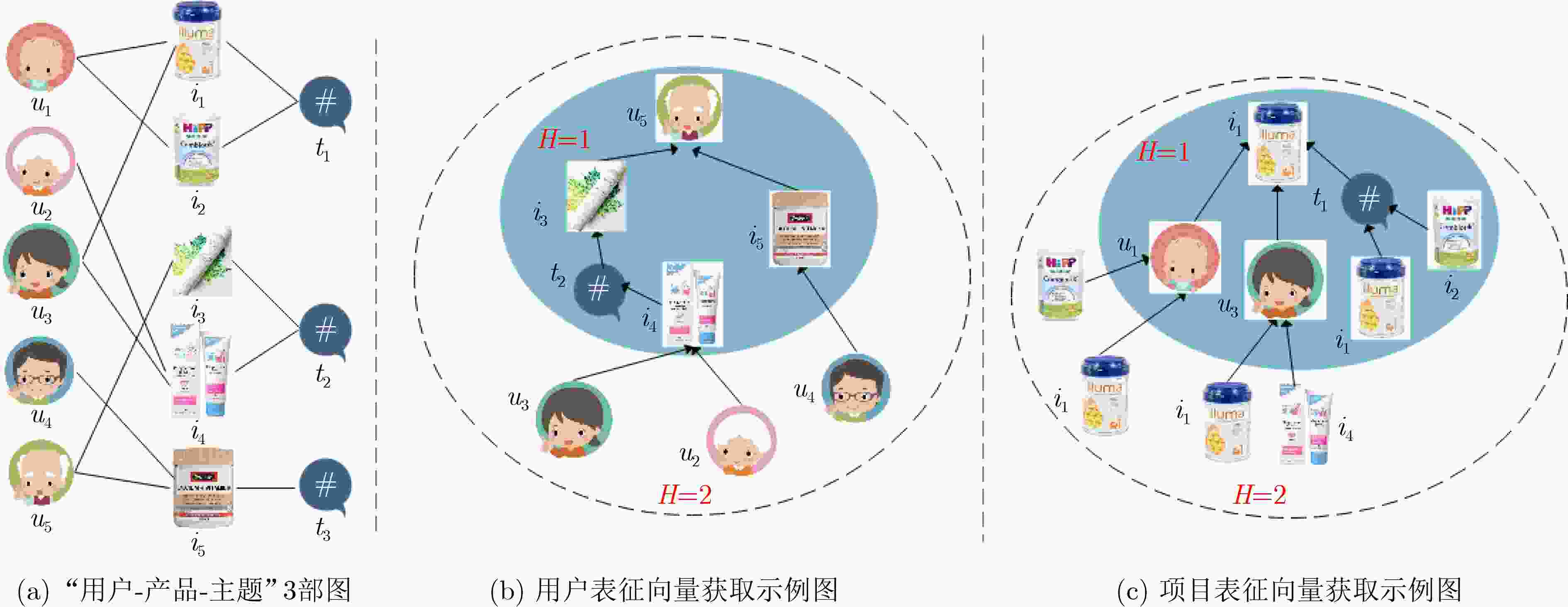

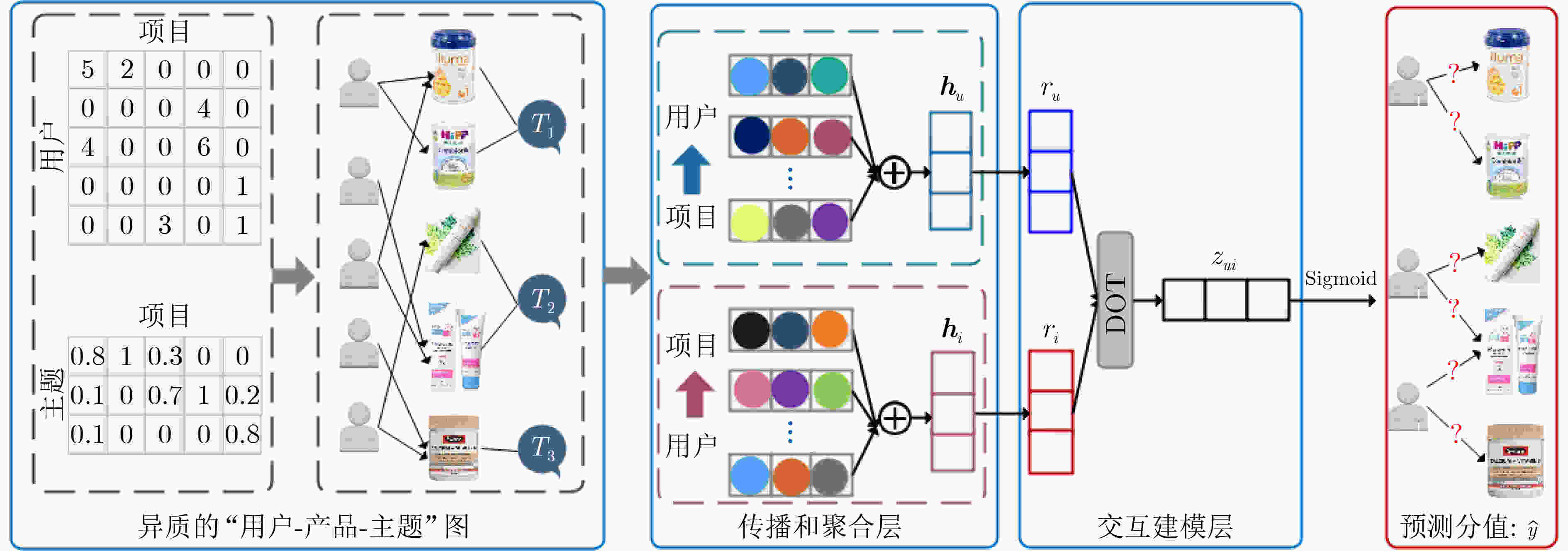

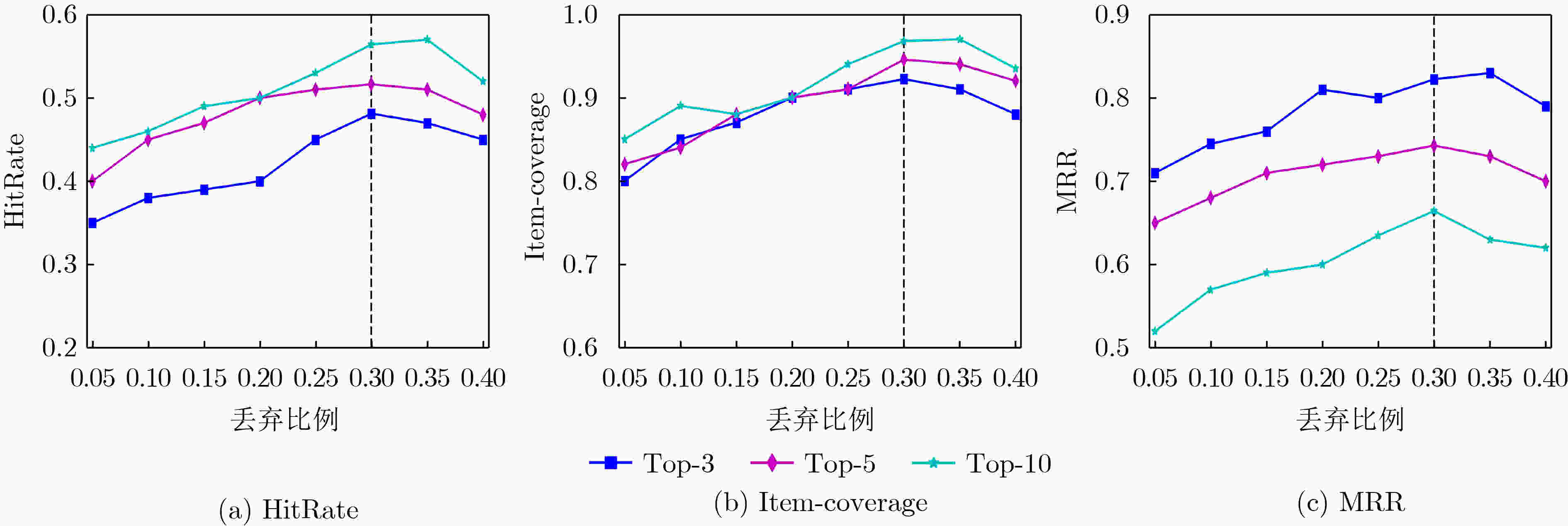

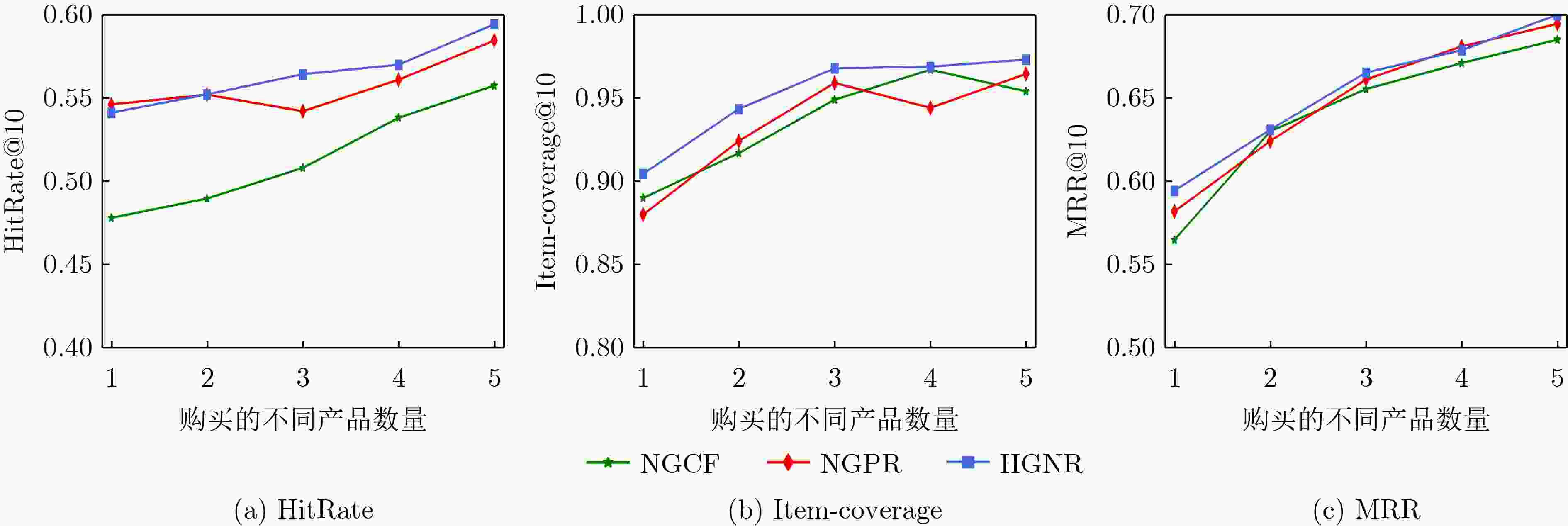

摘要: 跨境电商产品推荐已经成为电子商务领域新兴的研究议题之一。由于电商产品信息复杂多样、“用户-产品”关联矩阵极为稀疏并且冷启动问题突出,因此传统的协同过滤推荐模型很难奏效。而改进的深度协同过滤模型,只考虑了用户对产品的“显式”和“隐式”的反馈信息,忽视了由用户与项目组成的图结构信息,推荐性能很难满足平台和用户的要求。为了解决这些难题,该文提出基于异质图表达学习的图神经网络模型(HGNR)用于个性化的跨境电商产品推荐,该模型具有2个显著的优势:(1) 构造“用户-产品-主题”3部图作为模型的输入,通过图卷积神经网络(GCN)在异质图上进行高质量信息传播和聚合;(2)能够获取高质量的用户和产品表征向量,实现了用户和产品复杂交互关系的建模。在真实的跨境电商订单数据集上的实验结果表明,HGNR模型不仅在推荐性能上表现出色,还能有效提升冷启动用户的推荐准确率,与9种推荐基准算法相比,HGNR在评价指标HitRate@10, Item-coverage@10, MRR@10上至少提升了3.33%, 0.91%, 0.54%。Abstract: Cross-border e-commerce products recommendation has become one of the emerging researching topics in the field of e-commerce. Due to the diversity and complexity of e-commerce product information, the “user-item” correlation matrix is extremely sparse and the cold start problem is prominent. As a result, the traditional collaborative filtering model seems to be malfunctional. Meanwhile, the improved recommendation model based on collaborative filtering or matrix factorization only considers the explicit and implicit feedback information of the users to the products, while ignoring the graph structure information composed of users and items, so that the recommendation performance is difficult to meet the requirements of the platform and users. To tackle these issues, a recommender system of cross-border e-commerce based on heterogeneous graph neural network, named Heterogeneous Graph Neural network Recommender system (HGNR), is proposed in this paper. The model has two significant advantages: (1) the three-part graph is used as input, and high-quality information dissemination and aggregation are carried out on heterogeneous graphs through Graph Convolutional neural Network (GCN); (2) high-quality user and product representation vectors can be obtained, and realize the modeling of the complex interaction between users and products. Experimental results on real cross-border e-commerce order data sets show that HGNR not only owns the superior performance, but also can effectively improve the recommendation accuracy of cold-start users. Compared with nine baseline methods for recommendation, HGNR achieves improvements of at least 3.33%, 0.91%, and 0.54% on evaluation metrics of HitRate@10, Item-coverage@10 and MRR@10.

-

表 1 总体性能比较(%)

模型 HR@3 Item-c@3 MRR@3 HR@5 Item-c@5 MRR@5 HR@10 Item-c@10 MRR@10 POP 2.90 1.85 62.33 8.97 3.09 34.23 30.77 6.17 21.19 ICF 22.92 91.98 78.67 27.52 93.83 69.38 33.33 94.44 59.59 UCF 24.97 79.01 77.17 29.08 85.19 69.52 33.49 93.21 62.11 SVD 7.88 65.73 61.14 12.34 78.86 50.07 18.26 86.15 45.53 NMF 9.37 68.71 63.55 14.51 79.18 53.11 20.06 85.75 51.36 CDL 29.03 88.21 76.54 35.23 90.48 70.97 38.55 93.32 63.42 DeepFM 30.67 89.45 79.98 34.78 90.67 71.05 40.76 93.47 62.71 NGCF 42.65 90.28 80.14 46.87 91.87 72.05 50.87 94.21 65.37 NGPR 46.79 91.23 80.67 50.31 92.85 74.67 54.61 95.91 66.07 HGNR 48.12 92.21 82.24 51.65 94.56 74.29 56.43 96.78 66.43 注: HR和Item-c分别代表HitRate和Item-coverage 表 2 GNN网络层数对推荐性能的影响(%)

模型 HitRate@10 Item-c@10 MRR@10 HGNR-1 GNN Layer 51.27 93.84 62.18 HGNR-2 GNN Layer 56.43 96.78 66.43 HGNR-3 GNN Layer 53.91 94.63 63.73 -

[1] 孙光福, 吴乐, 刘淇, 等. 基于时序行为的协同过滤推荐算法[J]. 软件学报, 2013, 24(11): 2721–2733. doi: 10.3724/SP.J.1001.2013.04478SUN Guangfu, WU Le, LIU Qi, et al. Recommendations based on collaborative filtering by exploiting sequential behaviors[J]. Journal of Software, 2013, 24(11): 2721–2733. doi: 10.3724/SP.J.1001.2013.04478 [2] RESNICK P, IACOVOU N, SUCHAK M, et al. GroupLens: An open architecture for collaborative filtering of netnews[C]. The 1994 ACM Conference on Computer Supported Cooperative Work, New York, USA, 1994: 175–186. [3] LINDEN G, SMITH B, and YORK J. Amazon. com recommendations: Item-to-item collaborative filtering[J]. IEEE Internet Computing, 2003, 7(1): 76–80. doi: 10.1109/MIC.2003.1167344 [4] KOREN Y. Factorization meets the neighborhood: A multifaceted collaborative filtering model[C]. The 14th ACM SIGKDD International Conference on Knowledge Discovery and Data Mining, New York, USA, 2008: 426-434. [5] WANG Yuxiong and ZHANG Yujin. Nonnegative matrix factorization: A comprehensive review[J]. IEEE Transactions on Knowledge and Data Engineering, 2012, 25(6): 1336–1353. doi: 10.1109/TKDE.2012.51 [6] PAZZANI M J and BILLSUS D. Content-based Recommendation Systems[M]. BRUSILOVSKY P, KOBSA A, and NEJDL W. The Adaptive Web. Berlin: Springer, 2007: 325–341. [7] BURKE R. Hybrid WEB Recommender Systems[M]. BRUSILOVSKY P, KOBSA A, and NEJDL W. The Adaptive Web. Berlin: Springer, 2007: 377–408. [8] XUE Hongjian, DAI Xinyu, ZHANG Jianbing, et al. Deep matrix factorization models for recommender systems[C]. The 26th International Joint Conference on Artificial Intelligence, Melbourne, Australia, 2017, 17: 3203–3209. [9] HE Xiangnan, LIAO Lizi, ZHANG Hanwang, et al. Neural collaborative filtering[C]. The 26th International Conference on World Wide Web, New York, USA, 2017: 173–182. [10] WANG Hao, WANG Naiyan, and YEUNG D Y. Collaborative deep learning for recommender systems[C]. The 21th ACM SIGKDD International Conference on Knowledge Discovery and Data Mining, New York, USA, 2015: 1235–1244. [11] GUO Huifeng, TANG Ruiming, YE Yunming, et al. DeepFM: A factorization-machine based neural network for CTR prediction[C]. The 26th International Joint Conference on Artificial Intelligence, Melbourne, Australia, 2017: 1725–1731. [12] HU Zhibin, WANG Jiachun, YAN Yan, et al. Neural graph personalized ranking for Top-N recommendation[J]. Knowledge-Based Systems, 2021, 213: 106426. doi: 10.1016/j.knosys.2020.106426 [13] HU Linmei, LI Chen, SHI Chuan, et al. Graph neural news recommendation with long-term and short-term interest modeling[J]. Information Processing & Management, 2020, 57(2): 102142. doi: 10.1016/j.ipm.2019.102142 [14] WU Shiwen, SUN Fei, ZHANG Wentao, et al. Graph neural networks in recommender systems: A survey[J]. arXiv preprint arXiv, 2011.02260v2, 2020. [15] WANG Xiao, JI Houye, SHI Chuan, et al. Heterogeneous graph attention network[C]. World Wide Web Conference, New York, USA, 2019: 2022–2032. [16] 朱桂祥, 曹杰. 基于主题序列模式的旅游产品推荐引擎[J]. 计算机研究与发展, 2018, 55(5): 920–932. doi: 10.7544/issn1000-1239.2018.20160926ZHU Guixiang and CAO Jie. A recommendation engine for travel products based on topic sequential patterns[J]. Journal of Computer Research and Development, 2018, 55(5): 920–932. doi: 10.7544/issn1000-1239.2018.20160926 [17] 王智强, 梁吉业, 李茹. 基于信息融合的概率矩阵分解链路预测方法[J]. 计算机研究与发展, 2019, 56(2): 306–318. doi: 10.7544/issn1000-1239.2019.20170746WANG Zhiqiang, LIANG Jiye, and LI Ru. Probability matrix factorization for link prediction based on information fusion[J]. Journal of Computer Research and Development, 2019, 56(2): 306–318. doi: 10.7544/issn1000-1239.2019.20170746 [18] 陈晋音, 黄国瀚, 张敦杰, 等. 一种面向图神经网络的图重构防御方法[J]. 计算机研究与发展, 2021, 58(5): 1075–1091. doi: 10.7544/issn1000-1239.2021.20200935CHEN Jinyin, HUANG Guohan, ZHANG Dunjie, et al. GRD-GNN: Graph reconstruction defense for graph neural network[J]. Journal of Computer Research and Development, 2021, 58(5): 1075–1091. doi: 10.7544/issn1000-1239.2021.20200935 [19] 李涵, 严明玉, 吕征阳, 等. 图神经网络加速结构综述[J]. 计算机研究与发展, 2021, 58(6): 1204–1229. doi: 10.7544/issn1000-1239.2021.20210166LI Han, YAN Mingyu, LV Zhengyang, et al. Survey on graph neural network acceleration architectures[J]. Journal of Computer Research and Development, 2021, 58(6): 1204–1229. doi: 10.7544/issn1000-1239.2021.20210166 [20] XU K, HU Weihua, LESKOVEC J, et al. How powerful are graph neural networks?[J]. arXiv preprint arXiv: 1810.00826, 2018. [21] ZHANG Shuai, YAO Lina, SUN Aixin, et al. Deep learning based recommender system: A survey and new perspectives[J]. ACM Computing Surveys, 2020, 52(1): 5. doi: 10.1145/3285029 [22] WANG Shoujin, HU Liang, WANG Yan, et al. Graph learning approaches to recommender systems: A review[J]. arXiv preprint arXiv: 2004.11718, 2020. [23] WANG Xiang, HE Xiangnan, WANG Meng, et al. Neural graph collaborative filtering[C]. The 42nd International ACM SIGIR Conference on Research and Development in Information Retrieval, New York, USA, 2019: 165–174. [24] PAN Zhiqiang, CAI Fei, CHEN Wanyu, et al. Star graph neural networks for session-based recommendation[C]. The 29th ACM International Conference on Information & Knowledge Management, New York, USA, 2020: 1195–1204. [25] WU Shu, TANG Yuyuan, ZHU Yanqiao, et al. Session-based recommendation with graph neural networks[C]. The Thirty-Third AAAI Conference on Artificial Intelligence, AAAI 2019, The Thirty-First Innovative Applications of Artificial Intelligence Conference, IAAI 2019, The Ninth AAAI Symposium on Educational Advances in Artificial Intelligence, Honolulu, USA, 2019: 346–353. [26] BLEI D M, NG A Y, and JORDAN M I. Latent dirichlet allocation[J]. The Journal of Machine Learning Research, 2003, 3(1): 993–1022. [27] ZHANG Mengqi, WU Shu, GAO Meng, et al. Personalized graph neural networks with attention mechanism for session-aware recommendation[J]. IEEE Transactions on Knowledge and Data Engineering, To be pulished. [28] RONG Yu, HUANG Wenbing, XU Tingyang, et al. Dropedge: Towards deep graph convolutional networks on node classification[J]. arXiv preprint arXiv: 1907.10903, 2019. [29] CAO Jie, WANG Youquan, HE Jing, et al. Predicting grain losses and waste rate along the entire chain: A multitask multigated recurrent unit autoencoder based method[J]. IEEE Transactions on Industrial Informatics, 2021, 17(6): 4390–4400. doi: 10.1109/TII.2020.3030709 [30] CAO Jie, WANG Youquan, BU Zhan, et al. . Compactness preserving community computation via a network generative process[J]. IEEE Transactions on Emerging Topics in Computational Intelligence, To be published. doi: 10.1109/TETCI.2021.3110086. -

下载:

下载:

下载:

下载: