Hyperspectral Image Classification Based on Multi-scale Superpixel Texture Preservation and Fusion

-

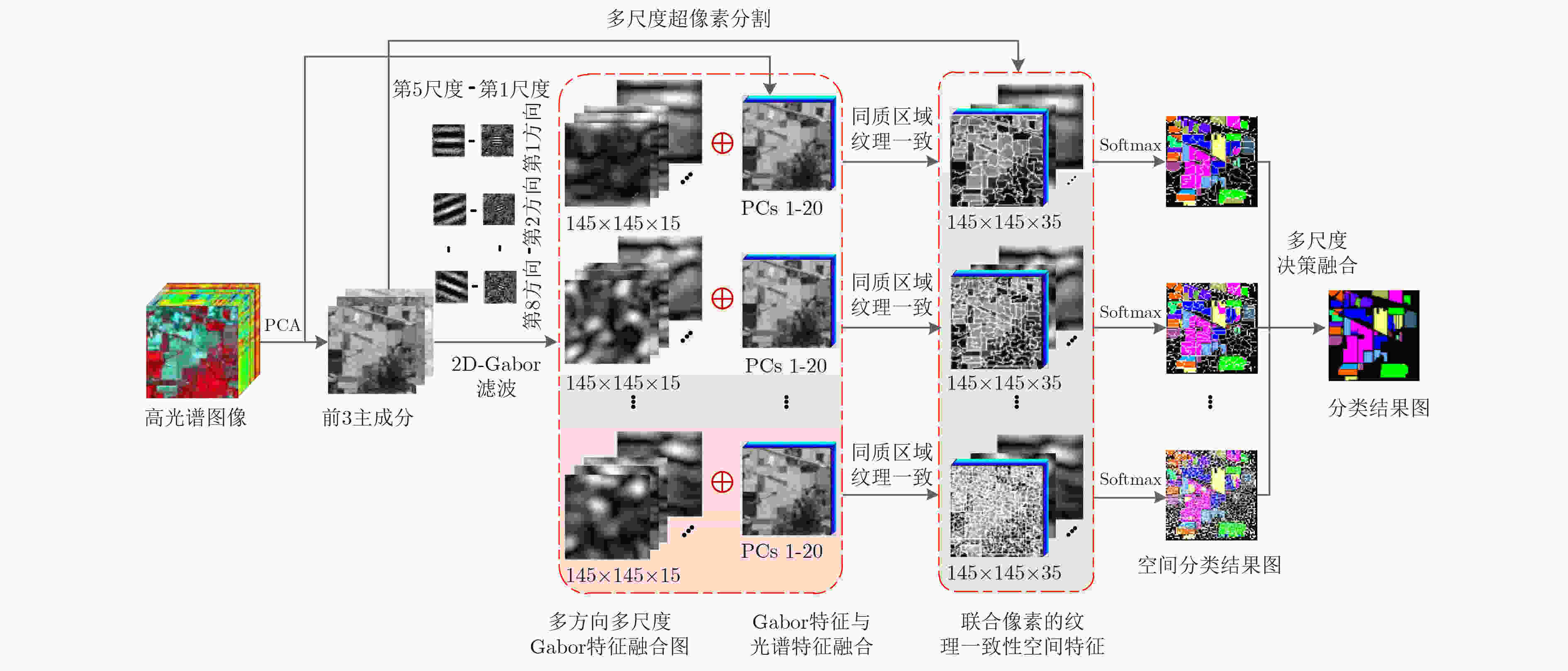

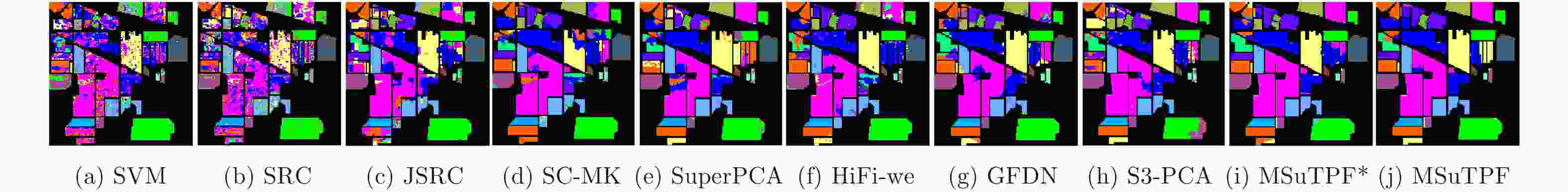

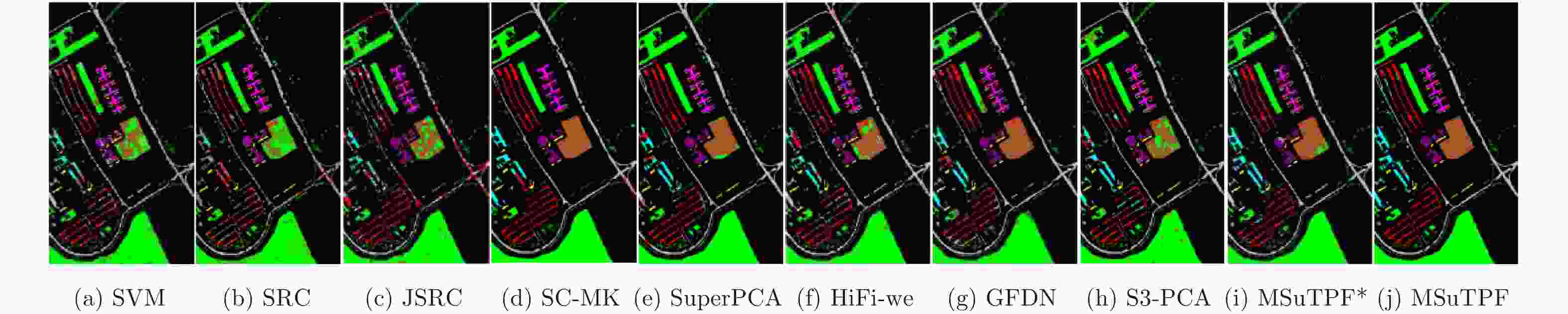

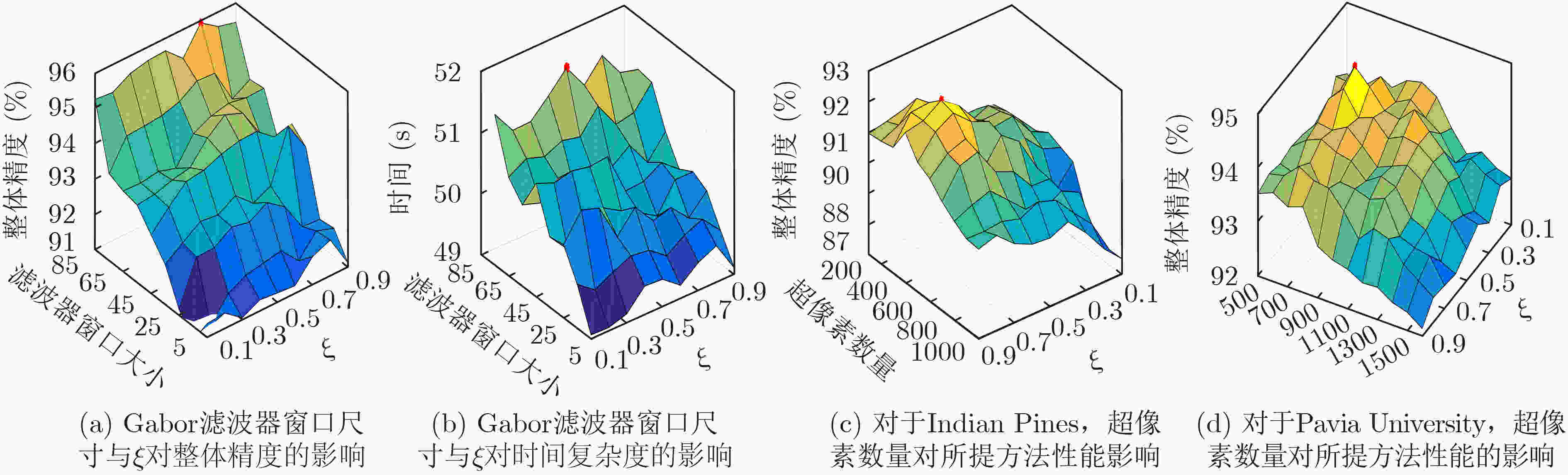

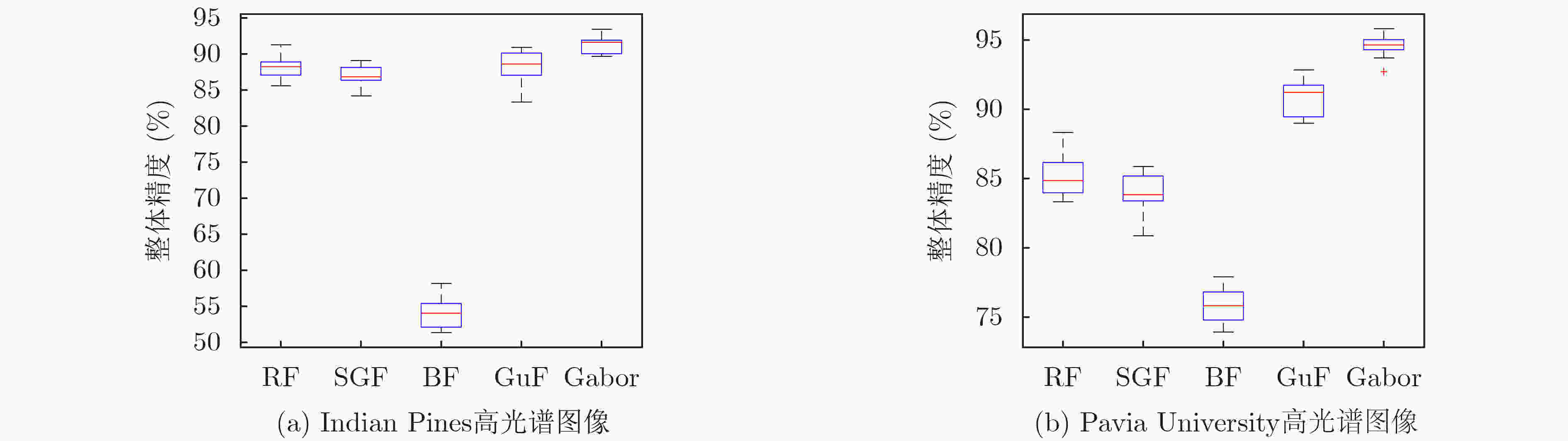

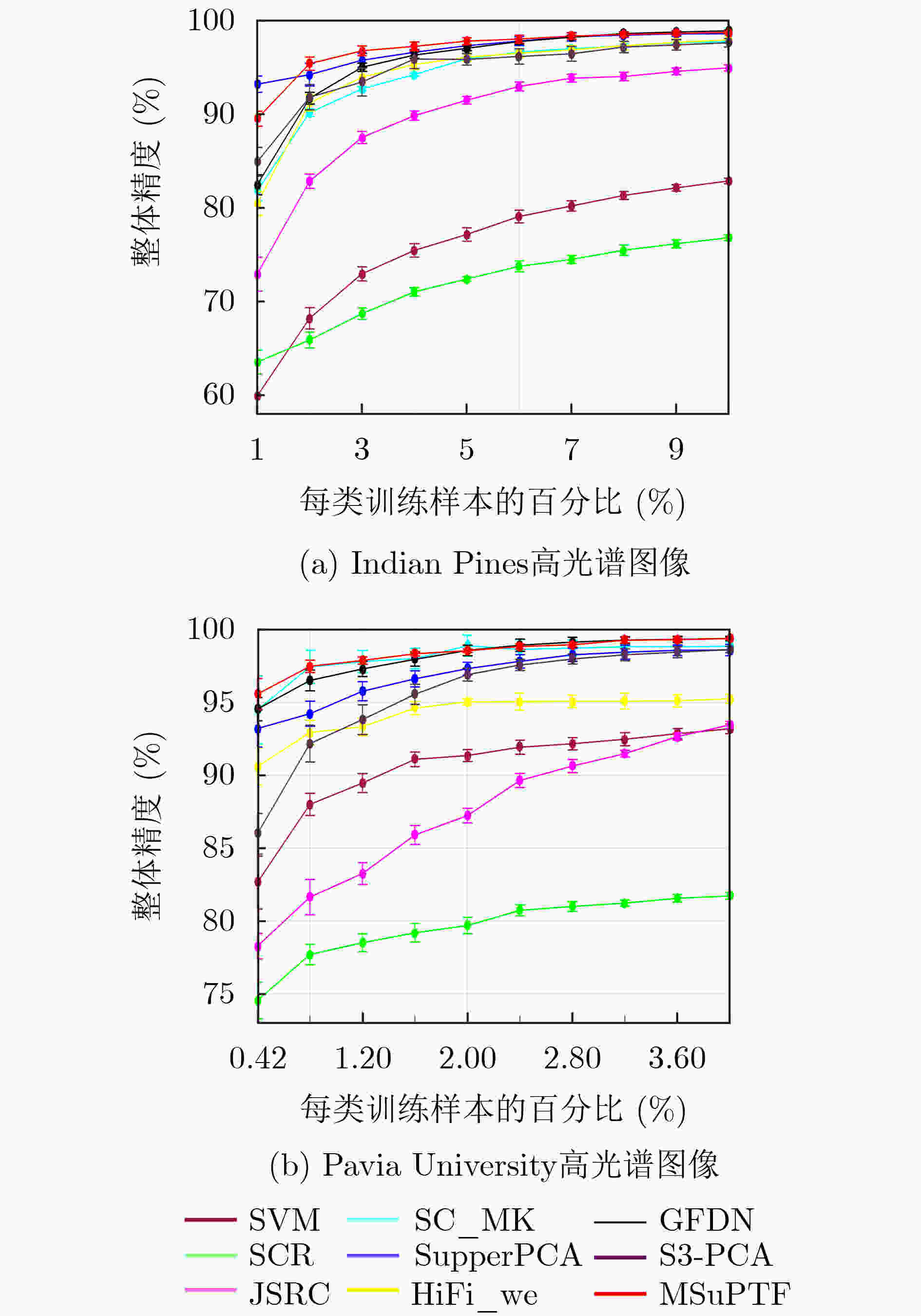

摘要: 高光谱图像的低空间分辨率特性往往导致全局纹理提取技术难以获取地物要素的精准纹理信息,同时,单一尺度的局部纹理提取技术难以达到有效识别地物的目的。基于此,该文设计了一种多尺度超像素纹理保持与融合(MSuTPF)的高光谱图像分类方法,主要架构如下:首先,利用2D Gabor滤波器对高光谱图像进行多方向与尺度的全局纹理提取,并通过融合各尺度的纹理特征,增强纹理结构表征能力;其次,融合纹理与光谱主成分特征以形成光谱-纹理联合判别特征;再次,采用形状自适应的超分割方法,作用至光谱-纹理联合特征进行局部纹理信息保持与融合,尤其是,为克服超像素邻域像元的隐性不相关问题,该文定义了基于密度最近邻相似性评价准则,使超像素纹理进一步趋于一致性;最后,将各更新的光谱-纹理联合特征输入像素级分类器获取其对应的类标签,并采用多数表决的决策融合机制取得最终分类结果。Indian Pines和Pavia University真实数据集的实验表明,该方法在小样本条件下的分类精度优于基准分类器(SVM)、深度学习方法(GFDN)以及最新的空-谱分类方法(S3-PCA)等8个对比方法,充分证明了该文所提方法的实用性和有效性。Abstract: The low spatial resolution characteristics of hyperspectral images often make it difficult for global texture extraction techniques to obtain accurate texture information and the single-scale local texture extraction technology is not satisfactory for effectively identifying the features. In this article, a Multi-scale Superpixel Texture Preservation and Fusion is proposed for hyperspectral image classification. Specifically, the original hyperspectral image is first extracted with multi-direction and scale global texture using 2D Gabor filter, and the texture feature of each scale is merged to enhance the texture structure characterization ability. Next, texture and spectral principal component features are fused to form spectral-texture joint discriminant features. After that, the shape adaptive oversegmentation method is applied to the spectral-texture joint feature for local texture information preservation and fusion. In particular, in order to overcome the hidden irrelevance problem of neighboring pixels, a density-based nearest neighbor similarity evaluation criterion is defined, which aims to make the superpixel texture more consistent. Finally, the updated spectral-texture joint discriminant features are input into the pixel-level classifiers to obtain their corresponding class labels, and the decision fusion mechanism of majority voting is adopted to obtain the final classification result. Experiments on the real data sets of Indian Pines and Pavia University show that the classification accuracy of this method under the condition of small samples is better than eight comparison methods such as the benchmark classifier Support Vector Machine (SVM), deep learning method Gabor Filtering and Deep Network (GFDN), and the latest spatial-spectral method Spectral-Spatial and Superpixelwise Principal Component Analysis (S3-PCA), which proves fully the practicability and effectiveness of the proposed method.

-

表 1 Indian Pines高光谱图像不同方法的分类精度(%)

客观指标 训练样本 测试样本 高光谱图像分类算法(部分经典的、主流的与最新的) SVM SRC JSRC SC-MK SuperPCA HiFi-we GFDN S3-PCA MSuTPF* MSuTPF OA 占比1.5% 占比98.5% 65.07 63.03 78.46 87.36 85.55 88.02 89.97 88.23 92.39 94.32 (1.66) (1.73) (1.90) (2.47) (2.42) (1.41) (1.57) (2.00) (1.21) (0.77) AA 62.55 67.57 80.50 89.60 75.13 82.87 89.30 86.49 94.19 95.00 (2.10) (1.67) (2.68) (2.83) (2.18) (2.29) (1.92) (2.31) (1.44) (1.99) Kappa 59.93 57.95 75.40 85.60 85.60 86.39 88.58 88.75 91.32 93.52 (1.83) (1.97) (2.18) (2.83) (2.73) (1.58) (1.78) (1.70) (1.38) (0.88) 表 2 Pavia University高光谱图像不同方法的分类精度(%)

客观指标 训练样本 测试样本 高光谱图像分类算法(部分经典的、主流的与最新的) SVM SRC JSRC SC-MK SuperPCA HiFi-we GFDN S3-PCA MSuTPF* MSuTPF OA 占比0.42% 占比99.58% 82.65 74.55 78.28 94.49 93.21 90.59 93.23 85.99 94.54 95.57 (1.81) (1.25) (1.27) (1.07) (1.92) (1.26) (0.87) (1.40) (0.80) (1.07) AA 80.04 70.48 69.11 91.39 89.15 88.64 90.47 81.22 94.28 95.86 (2.41) (2.05) (1.38) (1.57) (2.06) (1.71) (1.37) (1.91) (1.28) (0.95) Kappa 76.73 65.66 70.74 92.67 92.27 87.46 90.92 81.22 92.72 94.08 (2.47) (1.75) (1.68) (1.43) (1.88) (1.68) (1.19) (1.54) (1.07) (1.44) 表 3 采用不同的2D-Gabor和ERS超像素分割处理方法在Indian Pines高光谱图像上的分类效果

指标 I-Gabor II-Gabor III-Gabor I-ERS II-ERS OA(%) 92.89(1.37) 93.79(2.03) 94.32(0.77) 93.68(0.91) 94.32(0.77) AA(%) 93.84(1.63) 95.11(1.35) 95.00(1.99) 93.14(2.97) 95.00(1.99) Kappa 91.88(1.55) 92.93(2.3) 93.32(0.88) 92.79(1.04) 93.32(0.88) 表 4 不同维数光谱特征对算法性能的影响

真实数据集 光谱特征维数 5 10 15 20 25 30 35 Indian Pines OA(%) 93.27 93.98 94.23 94.32 93.64 92.91 92.47 Kappa 0.9256 0.9331 0.9357 0.9352 0.9285 0.9226 0.9163 Pavia University OA(%) 94.39 94.86 95.14 95.57 95.42 95.21 94.83 Kappa 0.9287 0.9332 0.9391 0.9408 0.9494 0.9480 0.9331 -

[1] PRASAD S and BRUCE L M. Limitations of principal components analysis for hyperspectral target recognition[J]. IEEE Geoscience and Remote Sensing Letters, 2008, 5(4): 625–629. doi: 10.1109/LGRS.2008.2001282 [2] 罗甫林, 黄鸿, 刘嘉敏, 等. 基于半监督稀疏流形嵌入的高光谱影像特征提取[J]. 电子与信息学报, 2016, 38(9): 2321–2329. doi: 10.11999/JEIT151340LUO Fulin, HUANG Hong, LIU Jiamin, et al. Feature extraction of hyperspectral image using semi-supervised sparse manifold embedding[J]. Journal of Electronics &Information Technology, 2016, 38(9): 2321–2329. doi: 10.11999/JEIT151340 [3] CHEN Yi, NASRABADI N M, and TRAN T D. Hyperspectral image classification using dictionary-based sparse representation[J]. IEEE Transactions on Geoscience and Remote Sensing, 2011, 49(10): 3973–3985. doi: 10.1109/TGRS.2011.2129595 [4] YU Haoyang, GAO Lianru, LIAO Wenzhi, et al. Multiscale superpixel-level subspace-based support vector machines for hyperspectral image classification[J]. IEEE Geoscience and Remote Sensing Letters, 2017, 14(11): 2142–2146. doi: 10.1109/LGRS.2017.2755061 [5] TU Bing, ZHOU Chengle, LIAO Xiaolong, et al. Feature extraction via 3-D block characteristics sharing for hyperspectral image classification[J]. IEEE Transactions on Geoscience and Remote Sensing, 2020, 59(12): 10503–10518. doi: 10.1109/TGRS.2020.3042274 [6] TU Bing, ZHOU Chengle, PENG Jin, et al. Feature extraction via joint adaptive structure density for hyperspectral imagery classification[J]. IEEE Transactions on Instrumentation and Measurement, 2021, 70: 5006916. doi: 10.1109/TIM.2020.3038557 [7] 李光, 姜春雪, 刘争战, 等. Laws纹理能量结合灰度共生矩阵的遥感影像面状地物提取[J]. 测绘与空间地理信息, 2017, 40(7): 179–181,185. doi: 10.3969/j.issn.1672-5867.2017.07.057LI Guang, JIANG Chunxue, LIU Zhengzhan, et al. Polygon feature extraction of remote sensing image based on laws texture energy and gray level co-occurrence matrix[J]. Geomatics &Spatial Information Technology, 2017, 40(7): 179–181,185. doi: 10.3969/j.issn.1672-5867.2017.07.057 [8] JIA Sen, HU Jie, DENG Lin, et al. Fuzzy threshold-based uniform local binary patterns for hyperspectral imagery classification[C]. 2016 8th Workshop on Hyperspectral Image and Signal Processing: Evolution in Remote Sensing (WHISPERS), Los Angeles, USA, 2016: 1–4. doi: 10.1109/WHISPERS.2016.8071771. [9] XU Yan, DU Qian, LI Wei, et al. . Gabor-filtering-based probabilistic collaborative representation for hyperspectral image classification[C]. IGARSS 2018-2018 IEEE International Geoscience and Remote Sensing Symposium, Valencia, Spain, 2018: 5081–5084. doi: 10.1109/IGARSS.2018.8517805. [10] KANG Xudong, LI Chengchao, LI Shutao, et al. Classification of hyperspectral images by Gabor filtering based deep network[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2018, 11(4): 1166–1178. doi: 10.1109/JSTARS.2017.2767185 [11] LIU Chengjun and WECHSLER H. Gabor feature based classification using the enhanced fisher linear discriminant model for face recognition[J]. IEEE Transactions on Image Processing, 2002, 11(4): 467–476. doi: 10.1109/TIP.2002.999679 [12] TU Bing, ZHOU Chengle, LIAO Xiaolong, et al. Spectral-spatial hyperspectral classification via structural-kernel collaborative representation[J]. IEEE Geoscience and Remote Sensing Letters, 2021, 18(5): 861–865. doi: 10.1109/LGRS.2020.2988124 [13] WANG Xinyu, ZHONG Yanfei, ZHANG Liangpei, et al. Spatial group sparsity regularized nonnegative matrix factorization for hyperspectral unmixing[J]. IEEE Transactions on Geoscience and Remote Sensing, 2017, 55(11): 6287–6304. doi: 10.1109/TGRS.2017.2724944 [14] LIU Mingyu, TUZEL O, RAMALINGAM S, et al. Entropy-rate clustering: Cluster analysis via maximizing a submodular function subject to a matroid constraint[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2014, 36(1): 99–112. doi: 10.1109/TPAMI.2013.107 [15] MELGANI F and BRUZZONE L. Classification of hyperspectral remote sensing images with support vector machines[J]. IEEE Transactions on Geoscience and Remote Sensing, 2004, 42(8): 1778–1790. doi: 10.1109/TGRS.2004.831865 [16] FANG Leyuan, LI Shutao, DUAN Wuhui, et al. Classification of hyperspectral images by exploiting spectral-spatial information of superpixel via multiple kernels[J]. IEEE Transactions on Geoscience and Remote Sensing, 2015, 53(12): 6663–6674. doi: 10.1109/TGRS.2015.2445767 [17] JIANG Junjun, MA Jiayi, CHEN Chen, et al. SuperPCA: A superpixelwise PCA approach for unsupervised feature extraction of hyperspectral imagery[J]. IEEE Transactions on Geoscience and Remote Sensing, 2018, 56(8): 4581–4593. doi: 10.1109/TGRS.2018.2828029 [18] PAN Bin, SHI Zhenwei, and XU Xia. Hierarchical guidance filtering-based ensemble classification for hyperspectral images[J]. IEEE Transactions on Geoscience and Remote Sensing, 2017, 55(7): 4177–4189. doi: 10.1109/TGRS.2017.2689805 [19] ZHANG Xin, JIANG Xinwei, JIANG Junjun, et al. . Spectral-spatial and superpixelwise PCA for unsupervised feature extraction of hyperspectral imagery[J]. IEEE Transactions on Geoscience and Remote Sensing, To be published. doi: 10.1109/TGRS.2021.3057701. [20] KANG Xudong, LI Shutao, and BENEDIKTSSON J A. Feature extraction of hyperspectral images with image fusion and recursive filtering[J]. IEEE Transactions on Geoscience and Remote Sensing, 2014, 52(6): 3742–3752. doi: 10.1109/TGRS.2013.2275613 [21] 宁鸿章, 谭鑫, 李宇航, 等. 空-谱维联合Savitzky-Golay高光谱滤波算法及其应用[J]. 光谱学与光谱分析, 2020, 40(12): 3699–3704. doi: 10.3964/j.issn.1000-0593(2020)12-3699-06NING Hongzhang, TAN Xin, LI Yuhang, et al. Joint space-spectrum sg filtering algorithms for hyperspectral images and its application[J]. Spectroscopy and Spectral Analysis, 2020, 40(12): 3699–3704. doi: 10.3964/j.issn.1000-0593(2020)12-3699-06 [22] CHEN Zhikun, JIANG Junjun, ZHOU Chong, et al. SuperBF: Superpixel-based bilateral filtering algorithm and its application in feature extraction of hyperspectral images[J]. IEEE Access, 2019, 7: 147796–147807. doi: 10.1109/ACCESS.2019.2938397 [23] JAIN A and GUPTA R. Gaussian filter threshold modulation for filtering flat and texture area of an image[C]. 2015 International Conference on Advances in Computer Engineering and Applications, Ghaziabad, India, 2015: 760–763. doi: 10.1109/ICACEA.2015.7164804. -

下载:

下载:

下载:

下载: