A Small Moving Object Detection Algorithm Based on Track in Video Surveillance

-

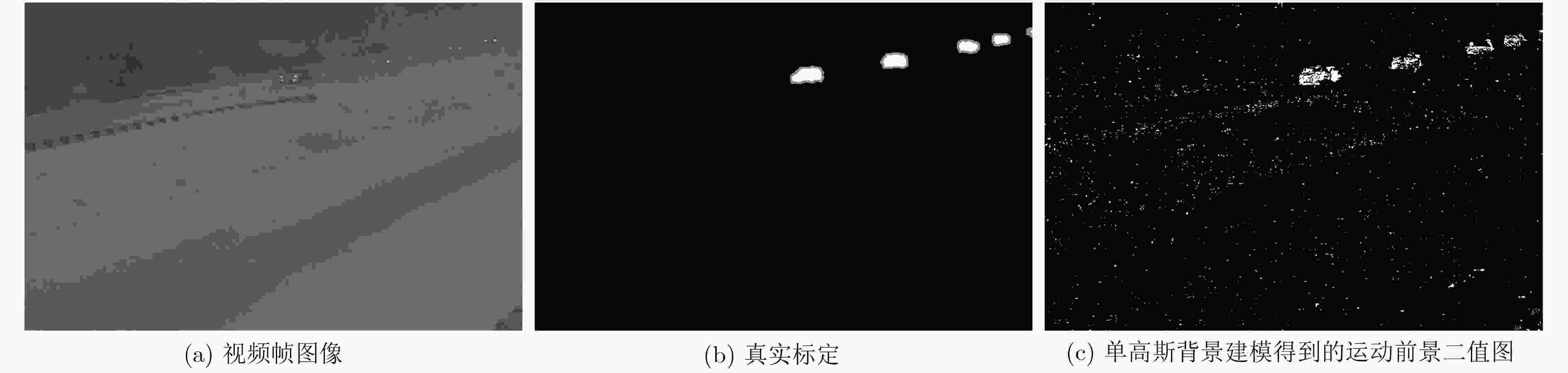

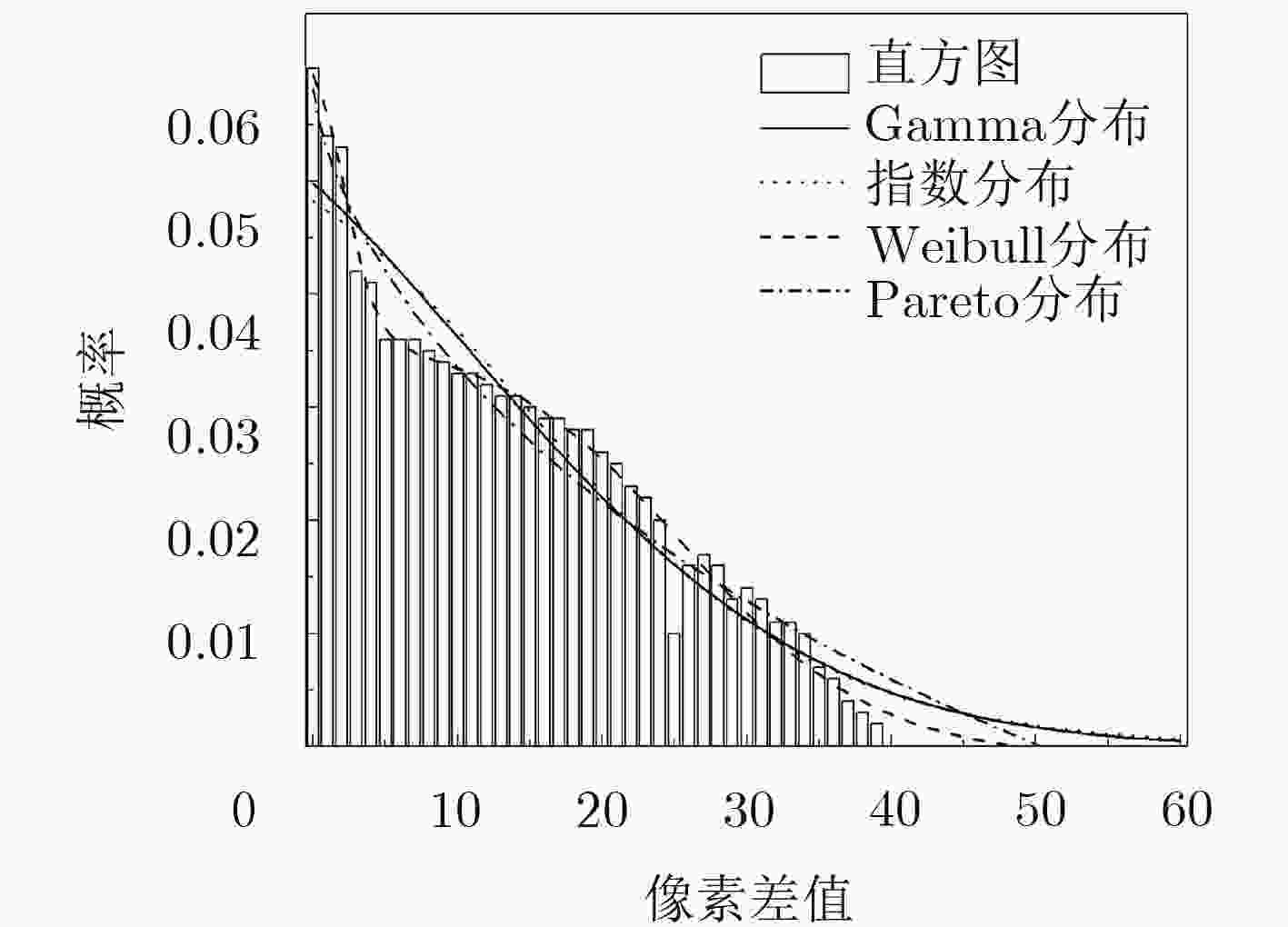

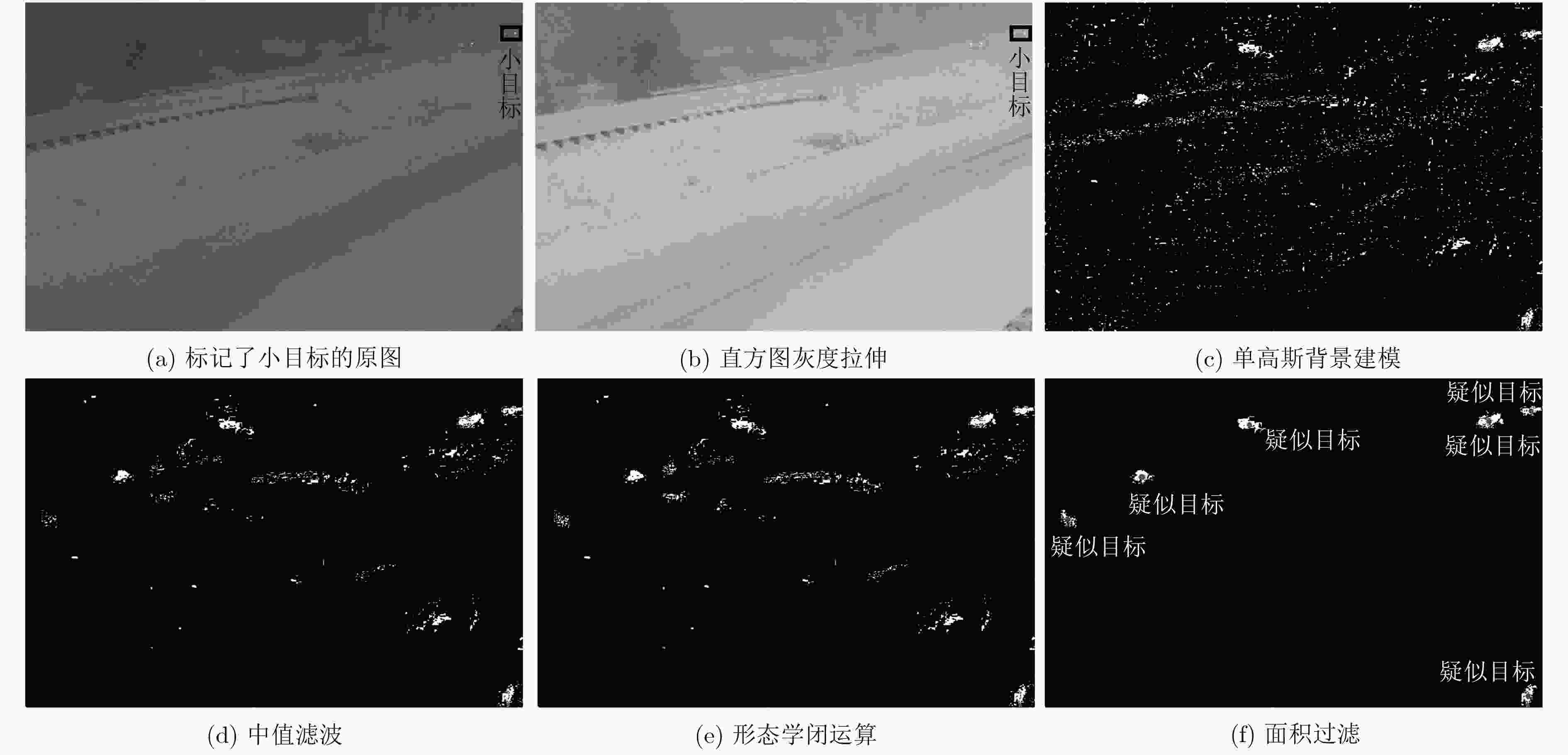

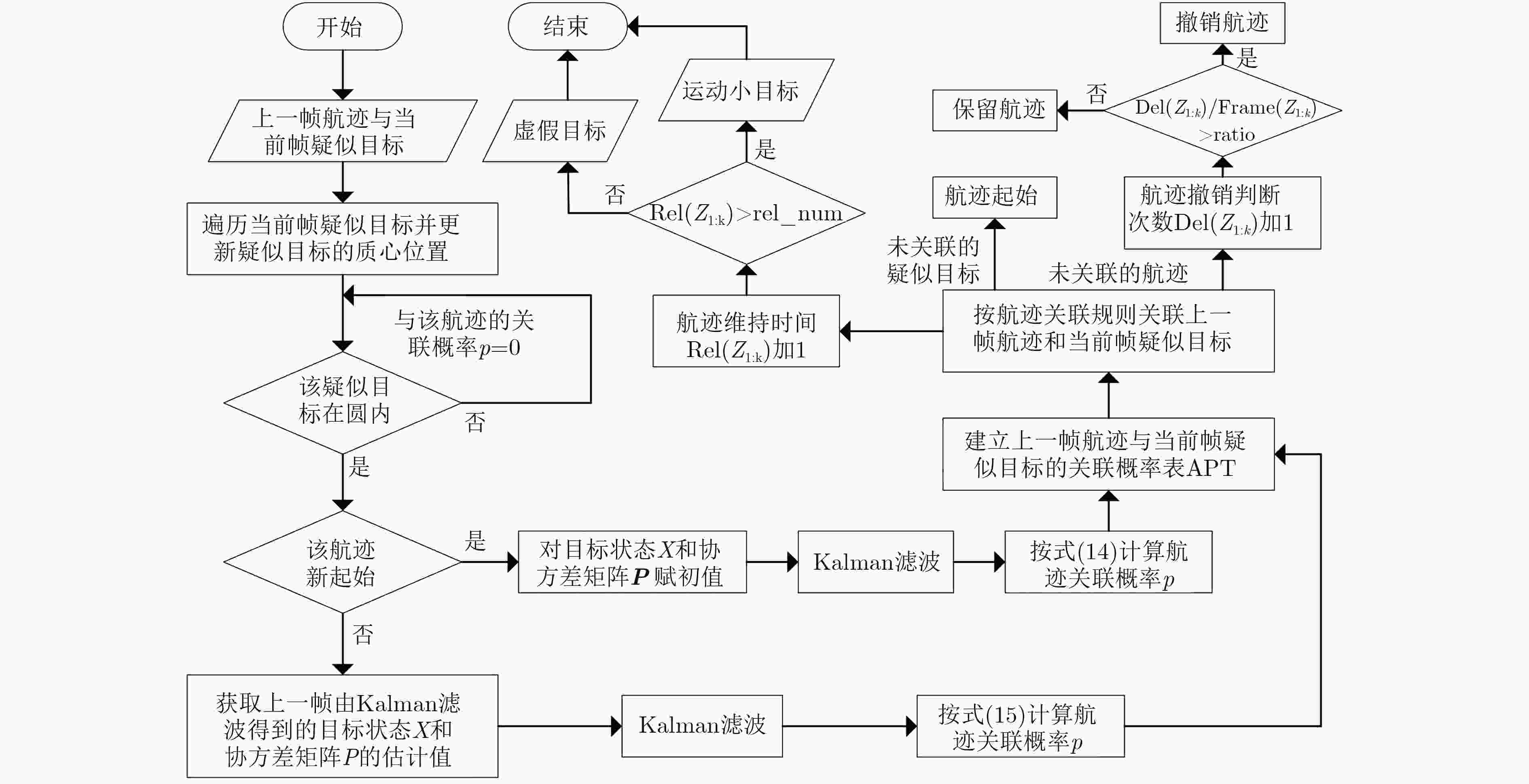

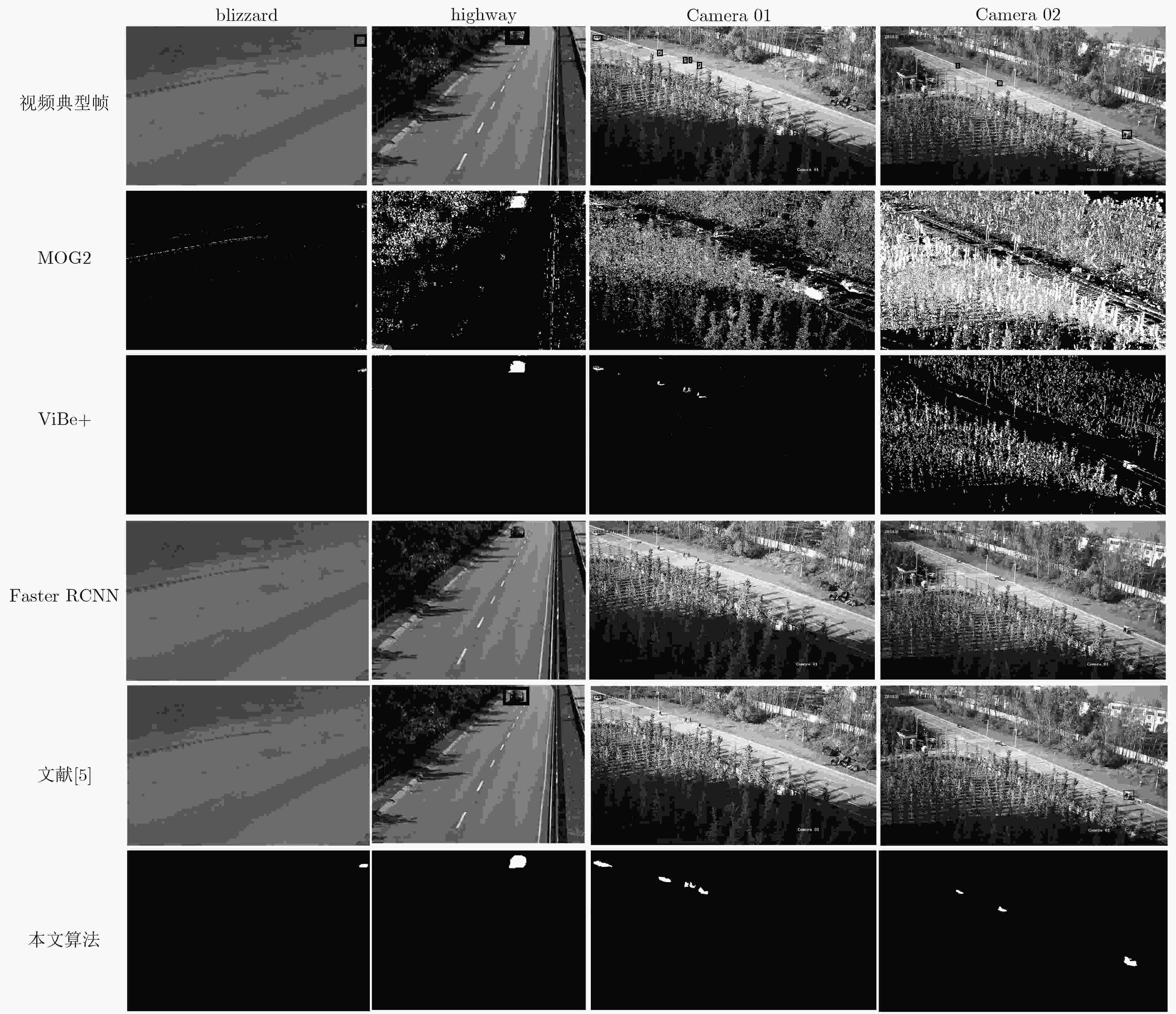

摘要: 针对视频监控中运动小目标难以检测的问题,该文提出一种基于航迹的检测算法。首先,为了降低检测漏警率,提出区域纹理特征与差值概率融合的自适应前景提取方法;其次,为了降低检测虚警率,设计航迹关联的概率计算模型以建立疑似目标在视频帧间的关联,并设置双门限以区分疑似目标中的真实目标与虚假目标。实验结果表明,与多种经典算法相比,该算法能对定量范围内的运动小目标以更低的漏警率和虚警率实施准确检测。Abstract: To solve the problem that small moving object is difficult to be detected in video surveillance, a track-based detection algorithm is proposed. Firstly, in order to reduce missing alarm, an adaptive foreground extraction method combining regional texture features and difference probability is presented. Then, for reducing false alarm, the probability computing model of track correlation is designed to establish the correlation of suspected objects between frames, and double-threshold are set to distinguish between true and false positive. Experimental results show that compared with many classical algorithms, this algorithm can accurately detect small moving object within the quantitative range with lower missing and false alarm.

-

Key words:

- Moving object detection /

- Small object detection /

- Track correlation

-

表 1 航迹关联规则

(1) do; (2) for $u = 1,2,·\!·· ,U$; (3) 寻找${\rm{APT}}{_{U \times V}\;}$中第$u$行中的最大值${a_{uv}}$,记录其列号$v$; (4) if第$v$列的最大值等于${a_{uv}}$; (5) break; (6) end if; (7) end for; (8) 关联$\{ {\text{Z}}_k^v\} $与$\{ \theta _{k - 1}^u\} $,删除${\rm{APT}}{_{U \times V}}\;$中的第$u$行和第$v$列元素,

$U = U - 1 ,V = V - 1$;(9) while ${\rm{APT}}{_{U \times V}}\;$中存在元素大于0。 表 2 5种算法在不同视频中的MA值比较

视频 图像尺寸(pix) 检测范围(%) 像素数 MOG2 ViBe+ Faster RCNN 文献[5] 本文算法 blizzard $ 720 \times 480$ 0.10~0.12 345~414 0.15 0.78 1.00 1.00 0.28 highway $ 320 \times 240$ 0.12~0.30 92~230 1.00 0.16 1.00 0.50 0.05 Camera 01 $ 1920 \times 1080$ 0.01~0.12 207~2488 0.38 0.29 1.00 0.86 0.11 Camera 02 $ 1920 \times 1080$ 0.01~0.12 207~2488 0.39 0.28 1.00 0.77 0.13 表 3 5种算法在不同视频中的FA值比较

视频 图像尺寸(pix) 检测范围(%) 像素数 MOG2 ViBe+ Faster RCNN 文献[5] 本文算法 blizzard $ 720 \times 480$ 0.10~0.12 345~414 0.71 0.21 0.00 0.00 0.18 highway $ 320 \times 240$ 0.12~0.30 92~230 0.37 0.61 0.00 0.00 0.29 Camera 01 $ 1920 \times 1080$ 0.01~0.12 207~2488 0.51 0.25 0.00 0.00 0.13 Camera 02 $ 1920 \times 1080$ 0.01~0.12 207~2488 0.52 0.17 0.00 0.00 0.14 -

CHEN Chenyi, LIU Mingyu, TUZEL O, et al. R-CNN for small object detection[C]. Proceedings of the 13th Asian Conference on Computer Vision, Taipei, China, 2016: 214–230. 邓鹤, 魏艳涛, 童名文, 等. 基于改进的局部反熵算子的小目标检测[J]. 通信学报, 2013, 34(4): 60–69. doi: 10.3969/j.issn.1000-436x.2013.04.007DENG He, WEI Yantao, TONG Mingwen, et al. Small target detection based on modified local reverse entropy operator[J]. Journal on Communications, 2013, 34(4): 60–69. doi: 10.3969/j.issn.1000-436x.2013.04.007 CAO Guimei, XIE Xuemei, YANG Wenzhe, et al. Feature-fused SSD: Fast detection for small objects[C]. Proceedings of SPIE 10615, Ninth International Conference on Graphic and Image Processing, Qingdao, China, 2017: 106151E. REN Shaoqing, He Kaiming, GIRSHICK R, et al. Faster R-CNN: Towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6): 1137–1149. doi: 10.1109/TPAMI.2016.2577031 LIN Tsungyi, DOLLÁR P, GIRSHICK R, et al. Feature pyramid networks for object detection[C]. Proceedings of 2017 IEEE Conference on Computer Vision and Pattern Recognition, Honolulu, USA, 2017: 936–944. 杨依忠, 汪鹏飞, 胡雄楼, 等. 基于鲁棒主成分分析的运动目标检测优化算法[J]. 电子与信息学报, 2018, 40(6): 1309–1315. doi: 10.11999/JEIT170789YANG Yizhong, WANG Pengfei, HU Xionglou, et al. Moving object detection optimization algorithm based on robust principal component analysis[J]. Journal of Electronics &Information Technology, 2018, 40(6): 1309–1315. doi: 10.11999/JEIT170789 ZIVKOVIC Z and VAN DER HEIJDEN F. Efficient adaptive density estimation per image pixel for the task of background subtraction[J]. Pattern Recognition Letters, 2006, 27(7): 773–780. doi: 10.1016/j.patrec.2005.11.005 VAN DROOGENBROECK M and PAQUOT O. Background subtraction: Experiments and improvements for ViBe[C]. Proceedings of 2012 IEEE Computer Society Conference on Computer Vision and Pattern Recognition Workshops, Providence, USA, 2012: 32–37. 薛阳, 张亚飞, 杨天宇, 等. 一种针对抖动视频序列的运动目标检测算法[J]. 激光与光电子学进展, 2018, 55(9): 091506.XUE Yang, ZHANG Yafei, YANG Tianyu, et al. A moving object detection algorithm aiming at jitter video sequence[J]. Laser &Optoelectronics Progress, 2018, 55(9): 091506. WREN C R, AZARBAYEJANI A, DARRELL T, et al. Pfinder: Real-time tracking of the human body[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1997, 19(7): 780–785. doi: 10.1109/34.598236 赵春江. C#数字图像处理算法典型实例[M]. 北京: 人民邮电出版社, 2009: 29–31.ZHAO Chunjiang. C# Digital Image Processing Algorithm for Typical Examples[M]. Beijing: Posts & Telecom Press, 2009: 29–31. 李长春, 王艳杰, 马春艳, 等. 多目标无人机微型凝视高光谱成像仪辐射校正[J]. 测绘通报, 2019(1): 60–64. doi: 10.13474/j.cnki.11-2246.2019.0012LI Changchun, WANG Yanjie, MA Chunyan, et al. Research on radiance correction of mini snapshot high spectrometer load on UAV using multi-target[J]. Bulletin of Surveying and Mapping, 2019(1): 60–64. doi: 10.13474/j.cnki.11-2246.2019.0012 THEODORIDIS S, 李晶皎, 王爱侠, 王骄, 等译. 模式识别[M]. 4版. 北京: 电子工业出版社, 2016: 282–288.THEODORIDIS S, LI Jingjiao, WANG Aixia, WANG Jiao, et al. translation. Pattern Recognition[M]. 4th ed. Beijing: Publishing House of Electronics Industry, 2016: 282–288. GONZALEZ R C, WOODS R E, 阮秋琦, 阮宇智, 等译. 数字图像处理[M]. 3版. 北京: 电子工业出版社, 2017: 423–430.GONZALEZ R C, WOODS R E, RUAN Qiuqi, RUAN Yuzhi, et al. translation. Digital Image Processing[M]. 3rd ed. Beijing: Publishing House of Electronics Industry, 2017: 423–430. 陈钱, 钱惟贤, 张闻文. 红外目标探测[M]. 北京: 电子工业出版社, 2016: 298–300.CHEN Qian, QIAN Weixian, and ZHANG Wenwen. Infrared Target Detection[M]. Beijing: Publishing House of Electronics Industry, 2016: 298–300. 姚天任, 孙洪. 现代数字信号处理[M]. 2版. 武汉: 华中科技大学出版社, 2018: 30–40.YAO Tianren and SUN Hong. Advanced Digital Signal Processing[M]. 2nd ed. Wuhan: Huazhong University of Science & Technology Press, 2018: 30–40. -

下载:

下载:

下载:

下载: